英语原文共 10 页,剩余内容已隐藏,支付完成后下载完整资料

使用循环一致性对抗网络进行未配对的图像到图像的转换

Jun-Yan Zhulowast; Taesung Parklowast; Phillip Isola Alexei A. Efros

伯克利人工智能研究(BAIR)实验室,加州大学伯克利分校

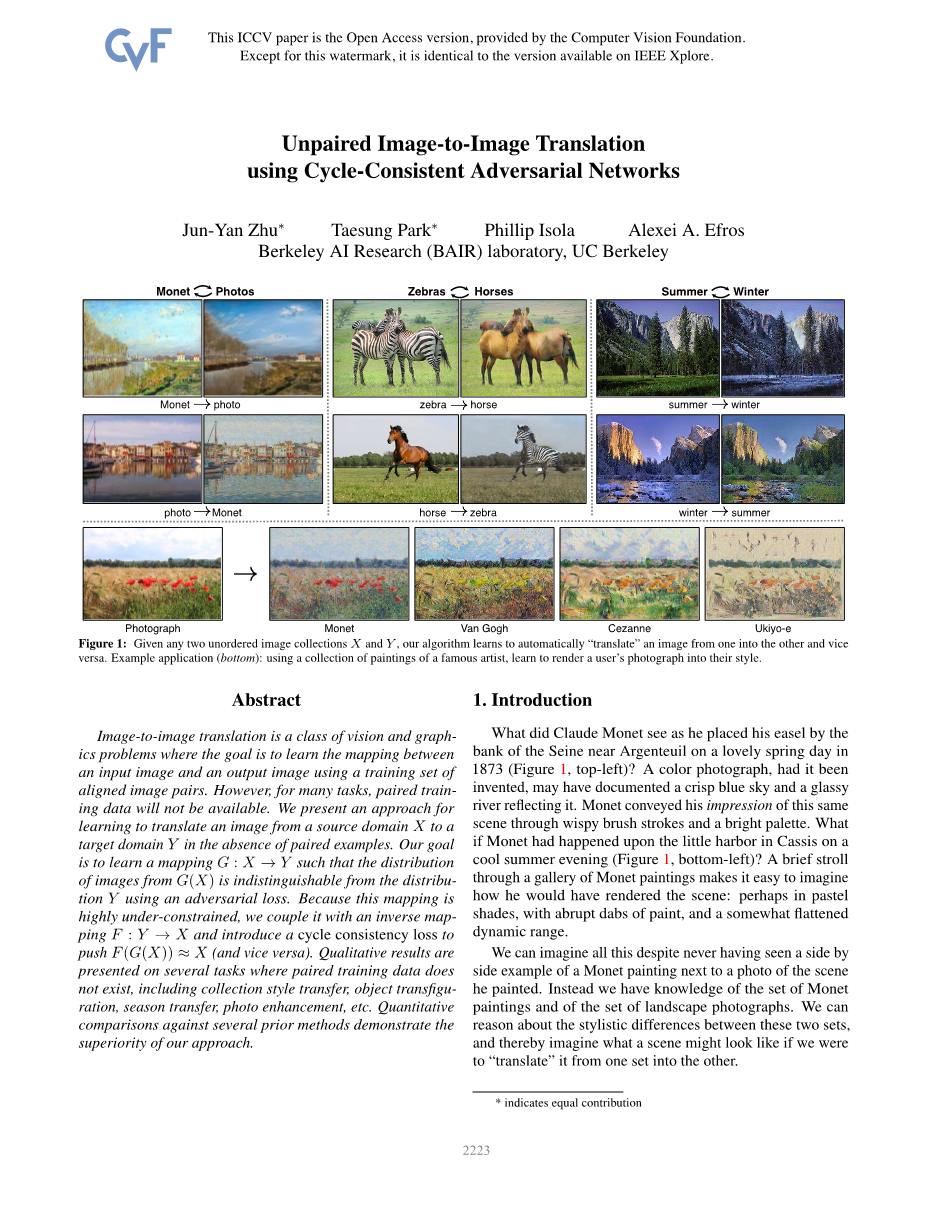

图 1:给定任意两个无序的图像集合X和Y,我们的算法会学习自动地将一个图像“翻译”到另一个,反之亦然。示例应用(底部):使用一个著名艺术家的作品集,学习将用户的照片呈现为他们的风格。

摘要

图像到图像的转换是一类视觉图像问题,其目标是使用一组成对的图像对来学习输入图像和输出图像之间的映射关系。然而,对于许多任务,成对的训练数据不易得到。提出了一种学习方法,在没有成对实例的情况下,将图像从源域X转换为目标域Y。我们的目标是学习一个映射G: X→Y,这样来自G(X)的图像的分布就不会与使用对抗损失的分布Y有区别。由于这种映射是高度欠约束的,我们将其与F: Y→X的逆映射耦合,并引入一个循环一致性损失来推动F(G(X))asymp;X(反之亦然)。在不存在成对训练数据的情况下,对采集样式转换、物体转换、季节转换、照片增强等任务进行定性分析。通过与已有方法的定量比较,证明了该方法的优越性。

1.引言

1873年一个美丽的春日,当克劳德·莫奈(Claude Monet)把他的画架放在阿让特伊附近的塞纳河岸边时,他看到了什么(图1,左上)?一张彩色照片,如果它是被拍摄出来的,可能已经记录了一个清脆的蓝天和反映它的玻璃河。莫奈通过纤细的笔触和明亮的调色板传达了他对同一场景的印象。如果莫奈在一个凉爽的夏夜偶然发现了卡西斯的小港口(图1,左下),那该怎么办?在莫奈(Monet)的画廊里走一走,很容易就能想象出他会如何描绘这一场景:也许是柔和的色调,生硬的颜料,还有一些平坦的动态范围。

我们可以想象所有这一切,尽管我们从未见过莫奈的画作与他所画场景的照片同时出现。相反,我们了解的是莫奈的画作和风景摄影。我们可以推断出这两个场景在风格上的不同,从而想象出如果我们把一个场景“翻译”成另一个场景会是什么样子。

本文中,我们提出了一个系统可以学习做同样的事情:捕获一个图像集合的特殊特征,并找出如何将这些特征转换到另一个图像集合中,所有这些都在没有任何成对的训练例的情况下。

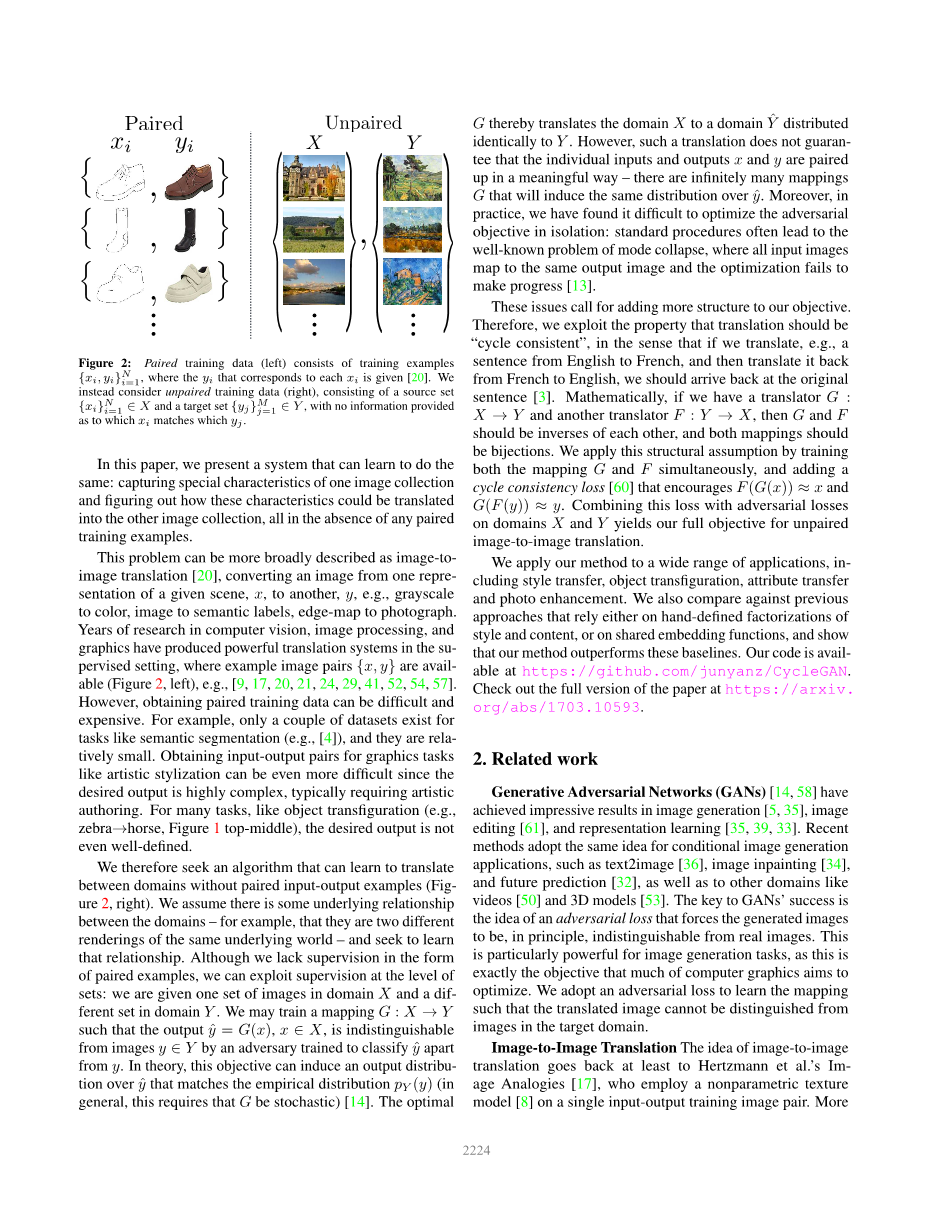

图 2:成对训练数据(左)由训练实例{xi,yi}Ni=1组成,其中yi与xi一一对应[20]。我们考虑的是未配对的训练数据(右),由原图像集{xi}N i=1isin; X和目标图像集{yj}M j=1isin; Y组成,没有xi与yi之间的匹配关系。

这个问题可以更广泛地描述为图像到图像转换[20],将一个图像从给定场景的一种表示形式x转换为另一种表示形式y,例如,灰度到颜色,图像到语义标签,边缘地图到照片。在计算机视觉、图像处理和图形学方面的多年研究已经在监督设置下产生了强大的翻译系统,其中的实例图像对{x, y}是可用的(图2,左),例如,[9,17,20,21,24,29,41,52,54,57]。然而,获得成对的训练数据可能是困难且代价昂贵的。例如,只有一些数据集存在于像语义分割这样的任务中(例如[4]),并且它们相对较小。为艺术风格化之类的图形任务获取输入-输出对可能更加困难,因为所需的输出非常复杂,通常需要艺术创作。对于许多任务,比如对象变形(例如,zebra→horse,图1中上部),所需的输出甚至没有明确定义。

因此,我们寻求一种无需成对输入-输出示例就能学会在域之间进行转换的算法(图2,右侧)。我们假设域之间存在某种潜在的关系——例如,它们是同一个潜在世界的两种不同呈现——并试图了解这种关系。虽然我们缺乏成对样本的监督,但我们可以利用集合层面的监督:给定X域中的一组图像和Y域中的另一组图像。我们可以使用对抗的思想训练一个映射G: X→Y,其输出为Ŷ= G (X), xisin;X,与yisin;Y无法区分。从理论上讲,这一目标可以产生一个与输出分布Ŷ相匹配的经验分布PY(y) (一般来说,这需要G是随机的)[14]。因此,最优的G将定义域X转化为定义域Ŷ,Ŷ与Y完全相同。但是,这样的转换并不保证单独的输入和输出x和y是以一种有意义的方式成对的--有无穷多个映射G会在Ŷ上产生相同的分布。此外,在实践中,我们发现很难单独优化对抗性目标:标准程序常常会导致众所周知的模式崩溃问题,即所有输入图像映射到相同的输出图像,而优化未能取得进展[13]。

这些问题要求为我们的目标增加更多的结构。因此,我们利用了翻译应该是“循环一致的”这一特性,也就是说,如果我们把一个句子从英语翻译成法语,然后再把它从法语翻译成英语,我们应该回到原来的句子[3]。从数学上讲,如果我们有一个G: X→Y和另一个F: Y→X的转换器,那么G和F应该是彼此的逆,而且两个映射都应该是双射。我们应用这种结构假设,通过同时训练映射G和F,并添加一个循环一致性损失[60],来推动F (G (x))asymp;x和G (F (y))asymp;y。将此损失与域 X 和 Y 的对抗性损失相结合,得出了我们完整的目标未配对的图像到图像的平移。

我们将我们的方法应用于广泛的应用领域,包括样式转换、物体转换、属性转换和照片增强。我们还比较了以前的方法,这些方法要么依赖于手工定义的样式和内容的因数分解,要么依赖于共享的嵌入函数,并表明我们的方法比这些基准方法性能更好。我们的代码可在https://github.com/junyanz/CycleGAN找到。全文请见https://arxiv.org/abs/1703.10593。

2. 相关工作

生成式对抗网络(GANs)[14,58]在图像生成[5,35]、图像编辑[61]、表征学习[35,39,33]等方面取得了令人瞩目的成果。最近的方法在条件图像生成应用中采用了相同的思想,如text2image[36]、image inpainting[34]、future prediction[32],以及video[50]、3D models[53]等领域。GANs成功的关键在于他提出了一种对抗性损失的概念,这种概念迫使生成的图像在原则上与真实图像难以区分。这对于图像生成任务特别强大,因为这正是许多计算机图形学旨在优化的目标。我们采用一种对抗性损失的方法来学习映射,使得转换后的图像与目标域中的图像无法区分。

图像-图像转换的概念至少可以追溯到Hertzmann等人的图像类比[17],他们在单个输入-输出训练图像对上使用非参数纹理模型[8]。最近的方法使用输入输出示例的数据集来学习使用CNNs的参数转换函数,例如[29]。我们的方法建立在Isola等人的“pix2pix”框架之上。[20],它使用条件生成对抗网络[14]来学习从输入到输出图像的映射。类似的想法已经被应用到各种任务中,比如从草图[40]或从属性和语义布局[22]生成照片。然而,与之前的工作不同的是,我们在没有成对训练示例的情况下学习映射关系。

未配对图像到图像的转换 其他几种方法也处理未配对的设置,其中的目标是关联两个数据域X和Y。Rosales等人[37]提出了一个贝叶斯框架,该框架包括基于源图像计算的基于补丁的马尔可夫随机场的先验,以及从多样式图像中获得的似然项。最近CoupledGANs[28]和cross-modal scene networks [1]使用权重共享策略来学习跨域的公共表示。与我们的方法一致,Liu等人[27]通过变异的自动编码器[23]和生成对抗网络的组合扩展了这个框架。另一行并行的工作[42,45,2]鼓励输入和输出共享某些“内容”特性,即使它们在“风格”上可能有所不同。它们还使用对抗性网络,并附加一些术语来强制输出接近预定义度量空间中的输入,例如类标签空间[2]、图像像素空间[42]和图像特征空间[45]。

与上述方法不同,我们的公式不依赖于输入和输出之间的任何特定于任务的、预先的相似性函数,也不假定输入和输出必须位于相同的低维嵌入空间中。这使得我们的方法成为许多视觉和图形任务的通用解决方案。我们在第5.1节中直接比较了几种先前的方法。在我们工作的同时,在这些相同的程序中,Yi等人[55]受机器翻译中双重学习的启发,独立地为未配对的图像到图像翻译引入了类似的目标[15]。

循环一致性 使用传递性作为结构化数据正则化方法的想法由来已久。在视觉跟踪中,执行简单的前后一致性是几十年来的标准技巧[44]。在语言领域,通过“反向翻译和再确认”来验证和改进翻译是人类译者[3](包括马克·吐温[47])以及机器使用的一种技术[15]。最近,高阶循环一致性被用于运动结构[56]、三维形状匹配[19]、共分割[51]、密集语义对齐[59,60]和深度估计[12]。其中,Zhou等人[60]和Godard等人[12] 最类似于我们的工作,因为他们使用循环一致性损失作为一种传递性来监督CNN训练的方式。在这项工作中,我们引入了一个类似的损失来推动G和F相互一致。

神经风格迁移[11,21,48,10]是执行图像到图像转换的另一种方法,通过匹配预先训练深度特征的Gram矩阵统计信息,将一个图像的内容与另一个图像(通常是绘画)的样式相结合来合成新图像。另一方面,我们的主要关注点是学习两个域之间的映射,而不是两个特定图像之间的映射,通过尝试捕捉更高层次的外观结构之间的对应关系。因此,我们的方法可以应用到其他任务,如绘画→照片,物体转换等,其中单一的样本转换方法表现不好。我们在第5.2节中比较了这两种方法。

图 3:(a)我们的模型包含两个映射函数G:X→Y和F:Y→X,以及相关的对抗性鉴别器DY和DX。DY鼓励G将X转换成与域Y不可区分的输出,反之对于DX、F和X亦然。为了进一步正则化映射,我们引入了两个“循环一致性损失”,对于这两个“循环一致性损失”达到这样的认识:如果我们从一个域转换到另一个域,然后再返回,我们应该到达我们最初的样子,即:(b)前向循环一致性损失:x→G(x)→F(x))asymp;x,和(c)后向循环一致性损失:y→F(y)→G(F(y))asymp;y

3. 规划

我们的目标是,给定训练示例{xi}Ni=1isin;X和{yi}Ni=1isin;Y,学习两个域X和Y之间的映射函数。如图3(a)所示,我们的模型包括两个映射G:X → Y和F:Y →X。此外,我们引入了两个对抗性鉴别器DX 和DY,其中DX旨在区分图像{X}和翻译后的图像{F(Y)};同样,DY旨在区分{Y}和{G(X)}。我们的目标包含两种术语:对抗性损失[14],用于将生成的图像分布与目标域中的数据分布相匹配;以及防止学习到的映射G和F相互矛盾的循环一致性损失。

3.1.对抗性损失

我们将对抗性损失[14] 应用于两个映射函数。对于映射函数G:X→Y及其鉴别器DY,我们将目标表示为:

(1)其中G试图生成与域Y中的图像相似的图像G(x),而DY旨在区分翻译的样本G(x)和真实样本y。我们为映射函数F:Y→X及其鉴别器DX引入类似的对抗性损失:即LGAN(F、DX、Y、X)。

3.2. 循环一致性损失

理论上,对抗训练可以学习映射G和F,它们分别产生与目标域Y和X相同分布的输出(严格地说,这要求G和F是随机函数)[13]。然而,在具有足够大容量的情况下,网络可以将同一组输入图像映射到目标域中的任意随机排列的图像,其中任何学习到的映射都可以产生与目标分布匹配的输出分布。为了进一步减少可能的映射函数的空间,我们认为学习的映射函数应该是循环一致的:如图3(b)所示,对于域X中的每个图像x,图像转换循环后应该能够使x回到原始图像,即x→G(x)→F(G(x))asymp;x。我们称之为前向循环一致性。类似地,如图3(c)所示,对于域Y、G和F中的每个图像y,还应满足后向循环一致性:y→F(y)→G(F(y))asymp;y。我们可以使用循环一致性损失来激励此行为:

(2)

在初步实验

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[254496],资料为PDF文档或Word文档,PDF文档可免费转换为Word