英语原文共 11 页,剩余内容已隐藏,支付完成后下载完整资料

基于深度神经网络的皮肤科医生级皮肤癌分类

摘要:

皮肤癌,人类最常见的恶性肿瘤,主要是视觉诊断,从最初的临床筛查和随访分析潜在的皮肤镜、活检和组织病理学检查。使用图像对皮肤病变进行自动分类是一项具有挑战性的任务,因为皮肤病变外观的细微变化。深度卷积神经网络(CNN)显示了许多细粒度物体类别的一般和高度可变任务的潜力。在这里,我们使用单个CNN证明皮肤损伤的分类,直接从图像端对端训练,仅使用像素和疾病标签作为输入。我们使用129,450张临床图像的数据集对CNN进行训练,比以前的由2,032种不同的疾病组成的数据集大两个数量级。我们通过21位经过董事会认证的皮肤科医师对经过活检证实的临床图像与两种关键二元分类用例进行了测试:角质形成细胞癌与良性脂溢性角化病;恶性黑素瘤与良性痣。第一个病例代表最常见的癌症的鉴定,第二个代表鉴定最致命的皮肤癌。CNN在这两项任务中的表现都达到了专家同样水平,表明人工智能皮肤癌的分类水平能与皮肤科医生相媲美。配备深度神经网络,移动设备可能会扩大皮肤科医师在诊所之外的认知范围。预计到2021年(参考文献13)将有63亿智能手机用户订购,因此可能提供低成本的全面的重要的诊断护理服务。

正文:

美国每年有540万新的皮肤癌病例。 五分之一的美国人在其生命中将被诊断为皮肤恶性肿瘤。尽管在美国黑色素瘤占所有皮肤癌的不到5%,但它们占所有皮肤癌相关死亡的约75%,并且仅在美国每年就有超过10,000人死亡。早期发现是至关重要的,因为如果在最早阶段检测到黑素瘤的5年存活率超过99%,如果在最晚阶段检测到存活率降至大约14%。我们开发了一种计算方法,可以使医生和患者能够主动跟踪皮肤损伤并更早发现癌症。通过创建新的疾病分类学和疾病分区算法将个别疾病映射到训练类,我们能够为皮肤科建立一个深度自动学习系统。由于数据不足和以皮肤镜检查和组织学图像分类等标准化任务为重点,以前在皮肤病学计算机辅助分类方面的工作缺乏医师的泛化能力。

通过专用仪器采集皮肤镜图像,并通过侵入性活检和显微镜获取组织学图像;由此两种模式产生高度标准化的图像。 摄影图像(例如智能手机图像)在变焦,角度和照明等因素中表现出可变性,使分类更具挑战性。我们通过使用数据驱动的方法克服了这一挑战---141万个预训练和训练图像使分类对照片变化稳健。许多先前的技术需要在分类之前进行大量的预处理,损伤分割和特定领域视觉特征的提取。相比之下,我们的系统不需要手工制作的特征; 它直接从图像标签和原始像素进行端对端培训,一种网络可以同时用于摄影和皮肤镜像。现有的工作使用小型数据集,通常少于一千个皮肤病灶图像,因此对新图像没有很好的概括。我们用一种新的皮肤科医生标记的129,450张临床图像数据集(包括3,374张皮肤镜图像)来证明可归纳的分类。深度学习算法在计算和超大型数据集方面取得突破,最近已被证明超过人类在视觉任务中的表现,如玩Atari游戏,战略棋盘游戏如Go和物体识别。在本文中,我们概述了与三项关键诊断任务中的皮肤科医师表现相匹配的CNN的发展:黑素瘤分类,使用皮肤镜检查的黑素瘤分类和癌分类。 我们将比较限制为基于图像的分类。

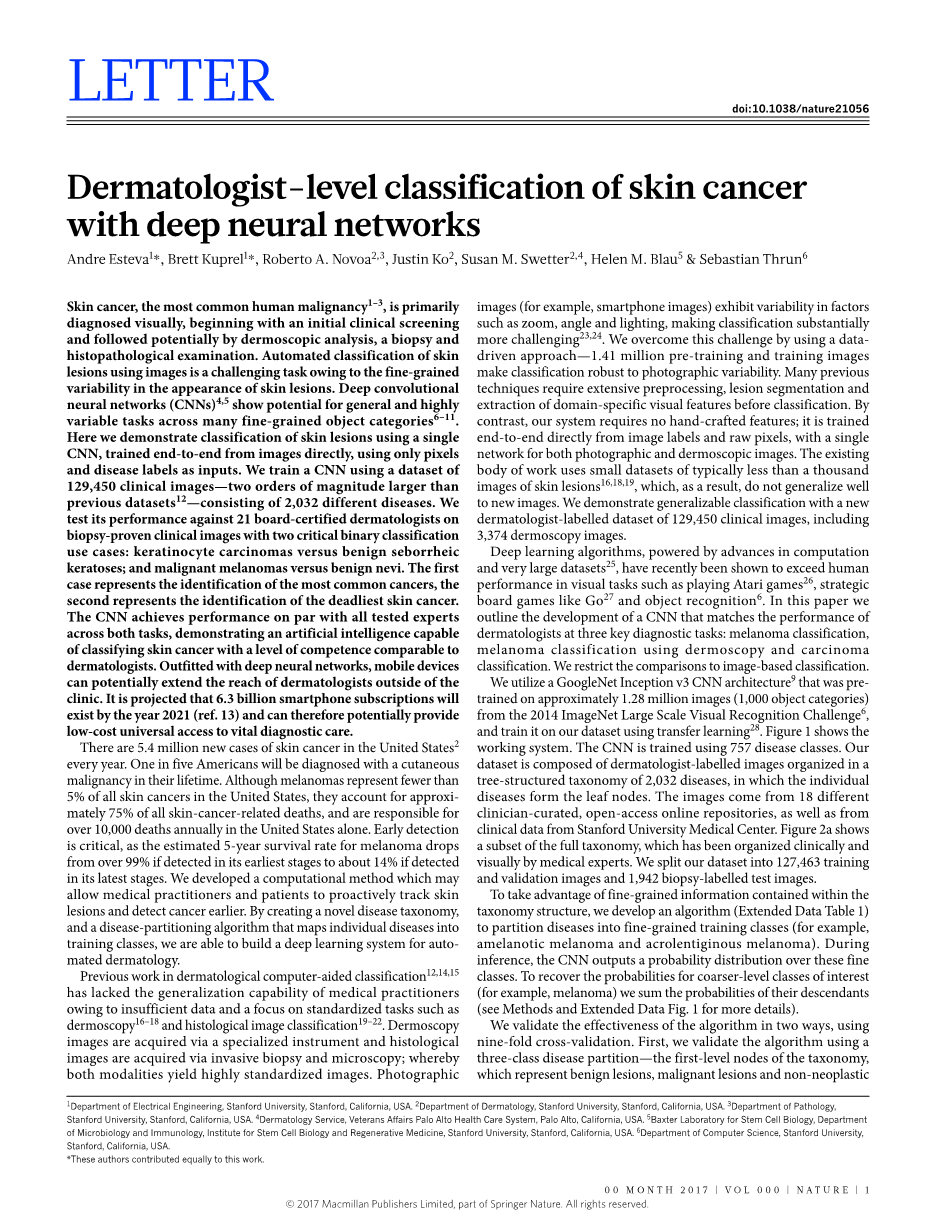

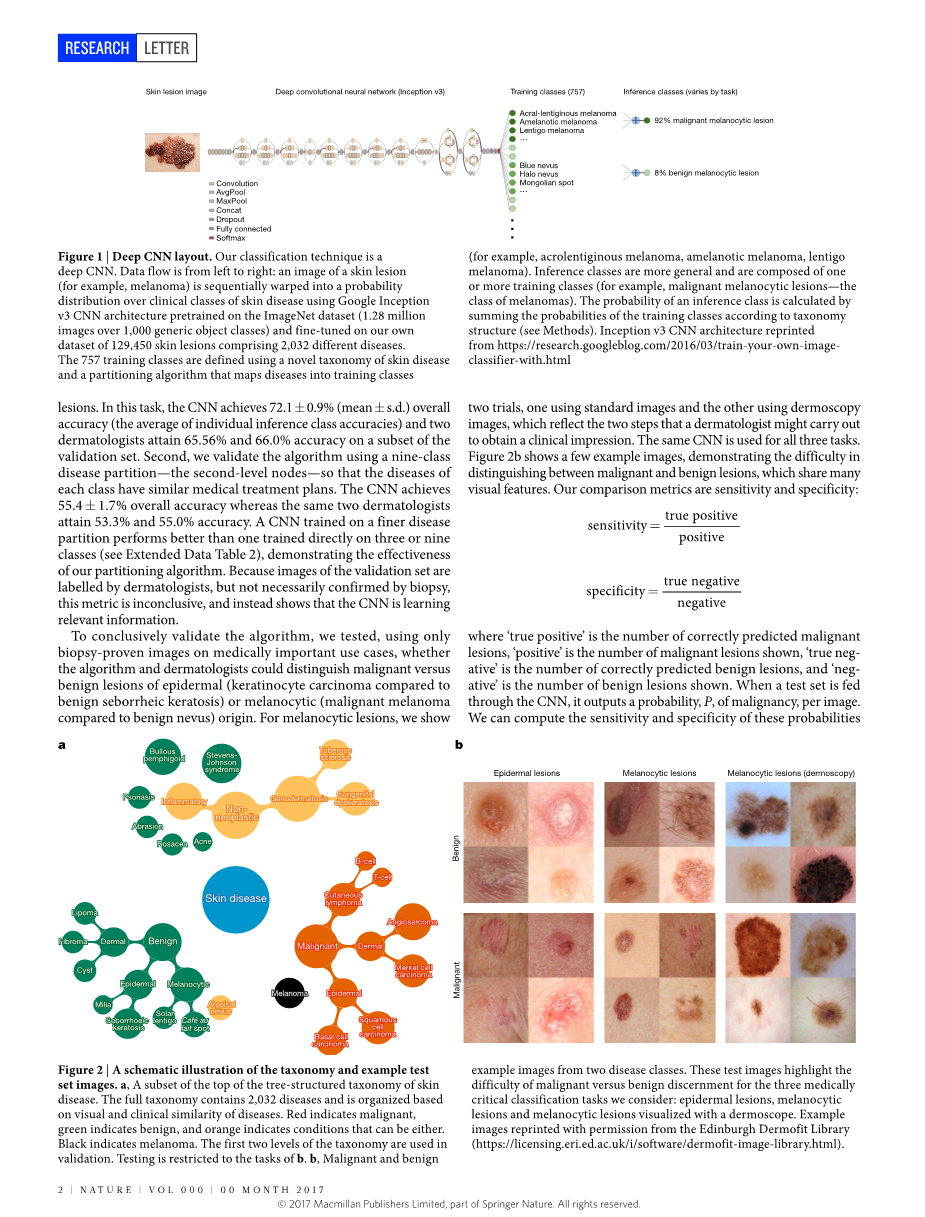

我们利用GoogleNet Inception v3 CNN架构,该架在2014年ImageNet大规模视觉识别挑战中预训练大约128万张图像(1,000种物体类别),我们使用转移学习在我们的数据集上进行训练。图1显示了工作系统。 CNN用757种疾病进行训练过。 我们的数据集由皮肤科医生标记的图像组成,树状结构分类为2032种疾病,其中各种疾病形成叶节点。这些图像来自18个不同的临床医生策划的开放式访问在线存储库,以及来自斯坦福大学医学中心的临床数据。图2a显示了完整的分类标准的一个由医学专家组织临床和视觉的子集。 我们将我们的数据集分成127,463个训练和验证图像以及1,942个活检标记的测试图像。

为了利用分类结构中包含的细粒度信息,我们开发了一种算法(扩展数据表1),将疾病划分为细粒度的训练类(例如,无黑素黑素瘤和丙烯黑素瘤)。在推断过程中,CNN输出这些精细类别的概率分布。 为了恢复较粗糙级感兴趣的概率(例如,黑素瘤),我们将其后代的概率相加(更多细节参见方法和扩展数据图1)。

我们使用九重交叉验证以两种方式验证算法的有效性。首先,我们使用三级疾病分区验证算法 - 分类的第一级节点,其代表良性病变,恶性病变和非肿瘤病变。在这项任务中,CNN达到72.1plusmn;0.9%(平均值plusmn;标准差)的整体准确度(个人推断类别准确性的平均值),两名皮肤科医生在验证集合的子集上达到65.56%和66.0%的准确性。其次,我们使用九级疾病分区 - 二级节点 - 验证算法,以便每个类别的疾病具有类似的医疗处理计划。CNN的整体准确度达到55.4plusmn;1.7%,而两位皮肤科医生的准确度达到53.3%和55.0%。训练更好的疾病分区的CNN比直接训练3或9类的CNN表现更好(参见扩展数据表2),证明了我们的分区算法的有效性。由于验证集的图像是由皮肤科医师标记的,但不一定通过活检证实,这一指标是不确定的,反而表明CNN正在学习相关信息。

为了最终验证该算法,我们测试了仅使用经活检证实的对医学重要用例的图像,算法和皮肤科医师是否可区分表皮(角质细胞癌与良性脂溢性角化病相比)的恶性病变与良性病变或黑素细胞(恶性黑素瘤相比良性痣)的起源。对于黑色素细胞病变,我们展示了两项试验,一项使用标准图像,另一项使用皮肤镜检查图像,这反映了皮肤科医生为获得临床印象可能执行的两个步骤。所有三项任务都使用相同的CNN。图2b显示了一些示例图像,显示了难以区分具有许多视觉特征的恶性和良性病变。 我们的比较指标是敏感性和特异性:

其中正确是正确预测的恶性病变的数目,正是所示的恶性病变的数目,真正的是正确预测的良性病变的数目,负是所示的良性病变的数目。当测试集通过CNN输入时,每个图像输出一个恶性概率P。 我们可以通过选择一个阈值概率t并且为每个图像定义预测来计算这些概率的敏感性和特异性,其中ŷ=Pge;t。 在区间0-1中变化的t产生了CNN可以实现的灵敏度和特性的曲线。

我们比较了CNN和至少21位经过董事会认证的皮肤科医师对表皮和黑素细胞病变分类的直接表现(图3a)。对于每张图片,皮肤科医生都会被问到是否要活检/治疗病变或让患者放心。图上的每个红点代表单个皮肤科医生的敏感性和特异性。CNN的表现优于任何皮肤科医生,其敏感度和特异性均低于CNN的蓝色曲线,这在大多数情况下都是如此。绿色点代表皮肤科医生的平均值(所有红色点的平均敏感度和特异度),误差线代表一个标准偏差。曲线下面积(AUC)为每种情况超过91%。 这个比较的图像(135个表皮,130个黑素细胞和111个黑素细胞皮肤镜图像)从整个测试集中采样。我们的整套活检标记图像的灵敏度和特异性曲线包括707个表皮,225个黑素细胞和1010个黑素细胞皮肤镜图像(图3b)。当我们比较样本数据集(图3a)和完整数据集(图3b)时,我们观察到AUC(lt;0.03)的微小变化,验证了我们在更大数据集上的结果的可靠性。在具有相似结果的独立分析中(见方法),皮肤科医师被问到他们是否认为病变是恶性的或良性的。

我们使用t-SNE(t分布的随机相邻嵌入)检查了CNN学习的内部特征(图4)。 每个点表示从CNN的最后隐藏层的2,048维输出投影到两维的皮肤损伤图像。我们看到相同临床类别的点集合(图4,插图显示不同疾病的图像)。 基底和鳞状细胞癌分裂成恶性表皮点云。黑素瘤集中在中央,而痣则集中在右侧。

类似地,脂溢性角化病与其恶性对应物相反。在这里,我们展示了皮肤科深层学习的有效性,该技术适用于一般皮肤状况和特定癌症。 我们使用单一卷积神经网络训练了一般皮肤病变分类,我们匹配了至少21位经过三项关键诊断任务测试的皮肤科医生的表现:角质形成细胞癌分类,黑素瘤分类和使用皮肤镜检查的黑素瘤分类。 这种快速,可扩展的方法可部署在移动设备上,并具有实质性临床影响的潜力,包括扩大初级护理实践的范围并扩大皮肤科专家的临床决策。进一步的研究是必要的,以评估在现实世界,临床环境中的表现,以验证这种技术在典型实践中遇到的病变的全部分布和范围。虽然我们承认皮肤科医生的临床印象和诊断是基于除了视觉和皮肤镜检查孤立病变之外的背景因素,但能够通过董事会认证的皮肤科医生的准确性对皮肤病变图像进行分类的能力有可能将访问深度扩展至重要的医疗护理。这种方法主要受数据约束,如果有足够的训练样例存在,可以分类许多视觉条件。 深度学习对使用的图像数据的类型是不可知的,并且可以适用于其他专业,包括眼科学,耳鼻喉科学,放射学和病理学。

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[21343],资料为PDF文档或Word文档,PDF文档可免费转换为Word

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。