英语原文共 10 页,剩余内容已隐藏,支付完成后下载完整资料

基于限制玻尔兹曼机运用深度信念网络的时间序列预测

摘要

多层感知器(MLP)和其他人工神经网络(ANNs)自20世纪80年代以来在时间序列预测中得到了广泛的应用。然而,对于应用中存在的初始化和局部最优等问题,人工神经网络的改进对于时间序列预测和其他智能计算领域来说,现在及将来都是最有意义的研究。在这项研究中,我们提出了一种运用由Hinton和Salakhutdinov提出的深度信念网络进行时间序列预测的方法,这种方法可以概率生成由多层次限制玻尔兹曼器组成的神经网络。我们采用一个三层网络受限玻尔兹曼机捕捉时间序列数据的输入空间的特征,并在运用他们的能量函数对限制玻尔兹曼机进行预训练后,执行梯度下降法训练,即用于调整可见层与隐藏层间连接权值的反向传播学习方法。为确定神经网络的大小和学习率,Kennedy 和Eberhart的粒子群优化算法(PSO)在训练过程中被采用。此外,一种对原始数据进行预处理的方法“趋势消除”也在运用CATS(人工时间序列竞争)基准数据的预测实验中进行了探讨。同时,该方法也适用于混沌时间序列的逼近和短时预测,如劳伦兹混沌和logistic映射。

关键词:时间序列预测;深度信念网络;限制玻尔兹曼机;多层感知器;CATS基准;混沌。

1.简介

自20世纪80年代以来,人工神经网络(ANNs)在时间序列预测中得到了广泛的应用。如Crone 和Nikolopoulos表示[1],直到2007,已经有超过5000关于人工神经网络预测出版物。著名的人工神经网络预测可被列为多层感知器(MLP),递归神经网络(RNN),径向基函数神经网络(RBFN),和其他的许多种类。为了训练这些模型,即找到合适的参数,通常使用梯度下降法。这些方法中最流行的学习算法是由Rumelhart,Hinton和 Williams提出的的“误差反向传播(BP)”[2],其可被视为人工神经网络研究领域的“里程碑”。

然而,人工神经网络在应用于现实世界的问题时仍然存在一些问题:

- 如何确定它们的结构?具有1个隐藏层和足够隐藏层单元的多层感知器可以实现任意非线性函数的逼近这一观点已被证明[3]。然而,众所周知,较大的隐藏层寸会产生了“过度拟合”的问题,因此对于实际问题,多层感知器的自适应结构是必需的[4,5]。

- 如何确定连接权值的初始值?BP是一种有监督学习,它使用教师信号(输入和输出数据样本)修改不同层上单元(神经元)之间的连接(突触)的权重,因此,这些连接的初始值会影响学习过程,这是一种从输入空间到输出空间的非线性映射。合适的初始权值可以加快学习收敛,且能避免学习过程陷入局部最优。

- 如何在训练中找到合适的学习率?学习率,即训练的一个阶段的参数变化率,也影响学习过程的速度。学习速度过快会导致学习收敛的不稳定,学习率过低会阻碍学习过程。

为了解决第一个问题,Kuremoto等人提出了一种自组织模糊神经网络(SOFNN)作为一个时间序列的预测,其单位由输入数据生成[6-8]。

对于第二个问题,Hinton等人提出了深度信念网络(DBN)[9],其采用逐层无监督学习方法对网络初始权值进行预训练,然后用全局监督学习进行微调。DBN已经成功地应用于降低维度(图像压缩)[10]、数字识别[11]、声音表示[12],并且仍在持续发展[13]。

在本文中,我们提出了由两个限制玻尔兹曼机(RBMS)组成的一个三层深度信念网络模型[14,15]用于时间序列预测。事实上,根据[9-13],当高维数据输入到限制玻尔兹曼机(RBM)“可见层”的单元,限制玻尔兹曼机(RBM)“隐藏层”的单元会根据连接权值来检测不同阶层之间数据的特征。限制玻尔兹曼机(RBM)的单元间的连接被限制在不同的层,即同一层的单元之间不存在连接,因此配对的层被命名为“限制玻尔兹曼机(RBM)。同时,当隐藏层被用作一个新的可见层,一个新的隐藏层会估计分类数据的特征,即第二个限制玻尔兹曼机(RBM)估计输入数据的特征的特征。使用这些组合限制玻尔兹曼机,即深度信念网络(DBN),我们构建了一个时间序列的近似模型并将其用作为一个预测。首先,通过可见层和隐藏层的能量函数概率的下降,来对深度信念网络(DBN)中限制玻尔兹曼机(RBM)的连接权值进行调整。随后,在无监督学习之后采用误差反向传播(BP)[2]进行微调。为了确定输入层和隐藏层的单元数和合适的学习率,我们采用粒子群优化算法(PSO)[16]对限制玻尔兹曼机进行设计。此外,根据神经网络预测模型[17,18]的特点,原始数据中的季节因素(趋势)被删除,即预处理的“差分时间序列”被提议用作预测器。

鉴于自2004年以来为时间序列预测竞争的问题提供服务[19,20],为了验证我们预测模型的有效性,我们决定采用CATS基准。此外,作为一种典型的行列式非线性现象,我们也对劳伦兹混沌[23]的时间序列数据进行了研究。预测结果表明,与多层感知器(MLP)[2]和传统的预测模型ARIMA[21]相比,我们提出的带有限制玻尔兹曼机的深度信念网络给出了更高的预测精度。

2.运用带有限制玻尔兹曼机的深度信念网络的预测器

第2.1节中提出了一种运用带有限制玻尔兹曼机的深度信念网络的预测器和学习算法,第2.2节中结构和的运用粒子群优化算法(PSO)的参数优化算法将被说明,第2.3节中介绍了对原始时间序列数据的预处理。

2.1 体系结构与学习算法

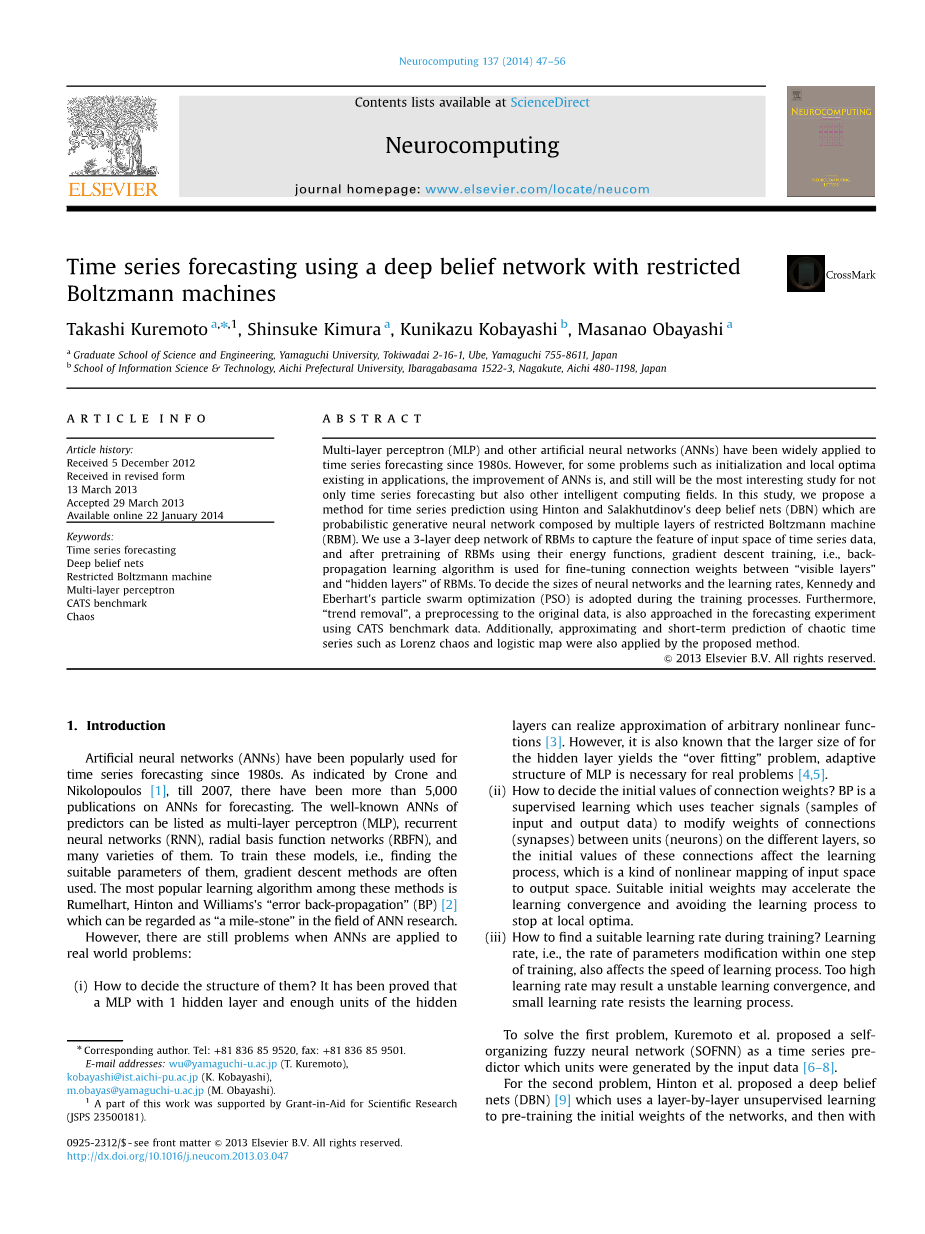

具有深度体系结构的人工模型(DAs)已经成为检索或表示高维数据的高级抽象特征的有力工具[[9-12]。在本文中,我们提出了一个如图1所示的带有两个限制玻尔兹曼机(RBMS)的深度信念网络(DBN)作为一个时间序列预测模型。这个模型的培训过程如下。

步骤1初始化。

步骤1.1每层RBM上的所有二进制单元随机设置为0或1,并且不同层的单元之间的对称连接权重为(0,1)中的随机值。 同一层RBM的单元不相互连接。

步骤1.2输入空间重建。对于时间序列,重建的时间序列数据被准备作为RBM1的可见层单元的输入,其中是正整数,,是输入空间的尺寸,即RBM1的可见层单元的数量,且如果。RBM1的可见层上的单位值等于输入数据:。

步骤2重复步骤2.1至步骤2.5,直到能量函数下降为收敛状态(这里我们使用与的变化有关的阈值来判断收敛)。

(1)

其中和是输入和特征的二进制状态,和是他们的偏差。

收敛条件可以表示为:

(2)

(3a)

(3b)

其中是正参数且足够小,是迭代次数,是常数,表示评估周期的长度。

步骤2.1隐藏层的单位的值, 即特征检测器被设置为1,其概率为:

(4a)

(4b)

其中是隐藏层单位的偏差,。

步骤2.2将设置为1,其概率为:

(5a)

(5b)

其中是隐藏层单位的偏差,。

步骤2.3计算期望值

,其中具有根据步骤2.1得到的二进制值。

步骤2.4计算期望值

,其中具有根据步骤2.2得到的二进制值,由步骤2.1给出。

步骤2.5将权重更改为:

(6)

其中是学习率。

步骤3设RBM1的隐含层为RBM2的可见层,如图1所示。对RBM2重复步骤1和

步骤2。

步骤4 RBM2单位的输出是未知未来的粗略预测值。

步骤5利用和之间的差异,即,它们的均方误差(MSE),BP算法[2]被执行以微调每个RBM的权重以获得精细预测。

步骤6如果MSE足够小则停止训练,即收敛为公式(7)。

(7)

其中是正参数且足够小,是BP算法的迭代时间。

步骤7将未训练的时间序列数据输入到训练的模型并预测未来的数据(单头,即,使用输出或一个长期预测,即,使用来预测)。

公式(6)中给出的学习规则被证实其在训练限制玻尔兹曼机成为[14,15]的输入数据的近似模型时表现良好。对于梯度下降训练方法,例如误差反向传播(BP)[2],初始权值将被设置为接近全局最小值,即最优解。所以式(6)作为利用BP神经网络学习算法的微调前的预训练,且这些学习算法使深度信念网络通过多输出层提取抽象特征。

图1.由深大度信念网络(DBN)构建的具有两个限制玻尔兹曼机(RBM)的预测器

2.2 模型优化

神经网络的结构需要被设计成可以满足其处理对象。当模型被应用于处理实际问题时,需要确定其层数,每层的单元数量和学习率等。在这里,我们使用3层深度信念网络,并采用Kennedy和Eberhart的粒子群优化算法(PSO)[16]来找到输入层和隐藏层上的最优单元数,以及限制玻尔兹曼机的学习率。

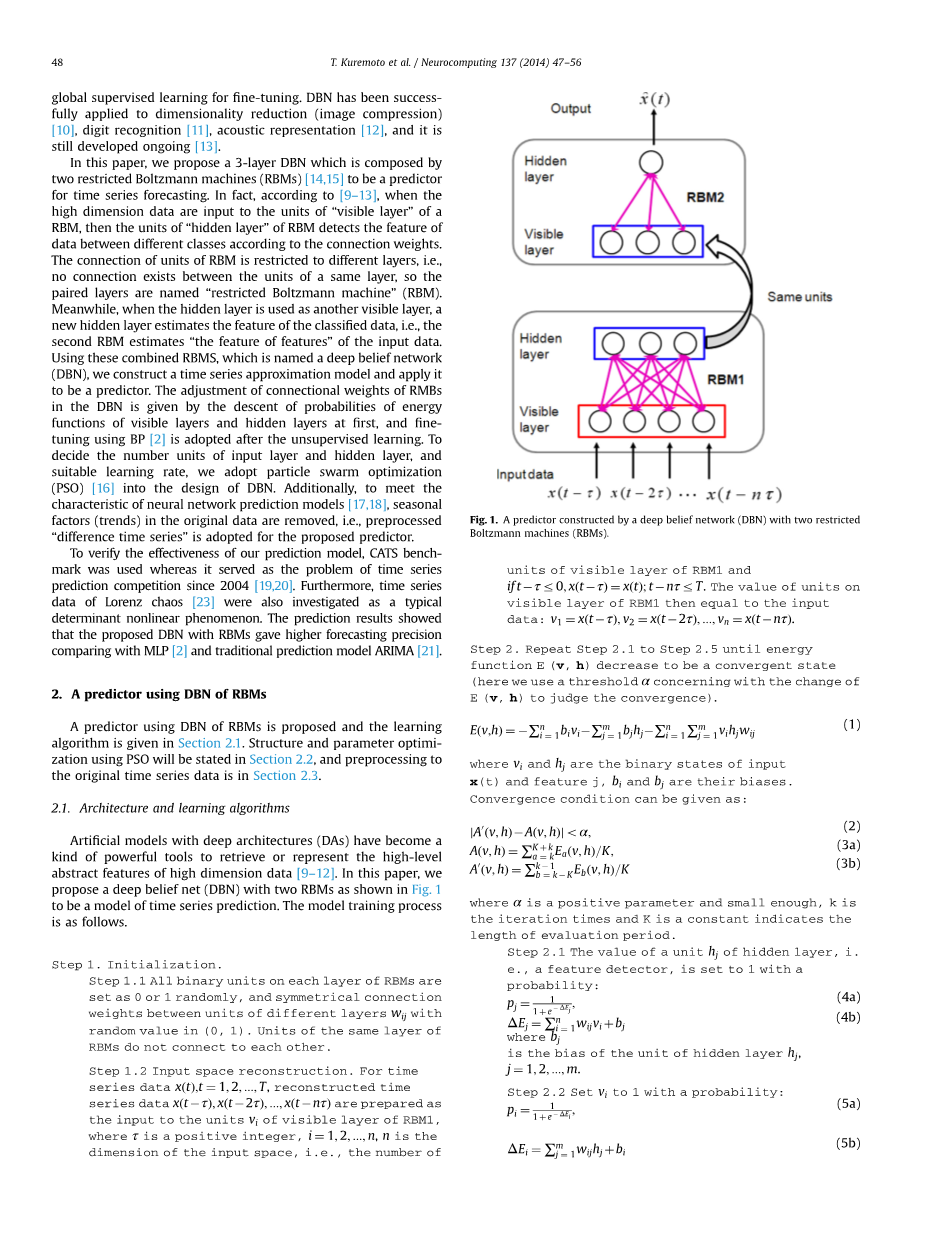

假设预测器如图1所示,即使用2个限制玻尔兹曼机。RBM1的可见层具有n个单元,RBM1的隐藏层具有与RBM2的可见层相同的m个单元。RBM2的隐藏层具有1个单位,即预测器的输出。考虑RBMɛ的学习率,一个粒子被设计成一个三维向量y(n,m,ɛ),且n=1,2,...,n,m=1,2,...,m,。准备具有足够尺寸P的这种粒子,即i=1,2,...,P,并使用[13]的PSO标准算法,深度信念网络(DBN)的优化预测器可以被构建。该处理的流程图如图2所示。

图2.使用最佳粒子设计一个DBN的优化预测器

用于决定DBN输入单元和隐藏单元的最佳数量的总结式PSO算法如下所示:

步骤1决定粒子P的种群大小和迭代次数I的限制。

步骤2.初始化每个粒子的起始位置和起始速度。

步骤3.使用预测值和教师数据之间的均方差(MSE)评估每个粒子,从历史中找出粒子的最佳位置, 并找出群体的最佳粒子位置。

步骤4通过公式分别更新粒子的位置和速度。

(8)

(9)

其中是正参数,随机值。

步骤5完成算法:

如果评估函数(训练数据的预测MSE)收敛,或,

否则

返回到步骤3。

2.3 差分时间序列

尽管人工神经网络(ANN)对非线性数据预测效果良好,但是当线性因子在时间序列中强烈存在时,它们会降低学习能力。于是,Zhang提出将线性预测模型ARIMA[21]与MLP结合起来以提高预测精度[17]。同时,Gardner和Mckenzie提出了一种平坦方法[18]对原始时间序列数据进行预处理并产生差异时间序列数据,如下所示:

(10)

其中d是时间的延迟,可以由ARIMA模型来决定。这个处理结果的一个例子如图3所示。原始时间序列显示了具有几个线性趋势的非线性,然而,根据公式(10)由时间延迟d=6获得的差分时间序列稳定在值0周围。不同的时间序列数据被用于训练人工神经网络,人工神经网络预测的未来数据将为。最终预测结果如下:

(11)

由于该提出的方法是一种多层神经网络,在CATS基准的情况下,我们使用了Gardner和Mckenzi提出的平坦方法[18],在混沌时间序列预测的情况下,我们使用了Zhang的混合模型[17],即ARIMA MLP和ARIMA SOFNN模型。

图3.时间延迟获得的原始时间序列数据及其差异数据6

3.预测结果

3.1 CATS基准

为了评估所提出的预测模型的性能,我们在两个预测实验中使用了基于CATS基准[19,20]的人造时间序列数据。

实验I:长期预测。

CATS数据在5个块中给出,且在每个块中,缺失20个数据,已知980个数据(见图4)。评估函数是如下计算100个缺失值和80个缺失值的均方误差E1和E2。通常,如果已知两个时间序列数据块之间的内部数据,则可以使用对应于前一个和后一个训练样本的两个模型。但是,对于CATS基准测试第5个块,在未知时间间隔后没有后面的数据。因此,根据自己的训练方法,E1可以更严

全文共6989字,剩余内容已隐藏,支付完成后下载完整资料

资料编号:[15553],资料为PDF文档或Word文档,PDF文档可免费转换为Word

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。