英语原文共 8 页,剩余内容已隐藏,支付完成后下载完整资料

压缩CNN架构以实现空中手写汉字识别

摘要

由于卷积神经网络(CNN)在计算机视觉领域带来了重大突破,因此最近已将其引入到空中手写汉字识别(IAHCCR)中,以实现更好的识别性能。但是,CNN通常会被过度参数化,并包含许多冗余过滤器或参数。这使CNN遭受了巨大的计算成本和相当大的存储使用量的困扰,从而限制了其在移动电话和智能电视等资源受限设备中的部署。在本文中,我们提出了一种统一的算法,可以有效地压缩IAHCCR的CNN,而精度损失很小。具体来说,我们首先利用信道剪枝策略来简化网络结构,然后采用网络量化技术来表示精度较低的参数。我们在空中手写数据集IAHCC-UCAS2016上进行了实验,其中基线CNN以15.5 MB的存储空间达到了95.33%的最新精度。压缩后,我们节省了12.4倍的存储空间和1.7倍的理论加速度,而精度损失仅为0.17%。此外,对包括ICDAR-2013和MNIST在内的其他基准数据集的评估进一步证明了该方法的有效性。

关键词:空中手写;手写汉字识别;卷积神经网络;网络压缩

目录

第一章 介绍

半个多世纪以来,手写汉字识别(HCCR)引起了很多研究者的关注,在这一领域已经取得了许多伟大的成就。随着当前技术的进步,近来手写已经扩展到空中等3D空间,并且这种空中手写也引起了极大的兴趣。与基于触摸设备的传统笔迹相比,空中笔迹使参与者可以用指尖或手在空中自由地直接自由书写语言字符或单词。特别是在这里,我们主要专注于解决空中HCCR(IAHCCR)。应当指出的是,由于种类繁多,写作风格的巨大差异以及许多相似字符的存在,HCCR仍然具有挑战性。但是,由于空中手写的独特特性,IAHCCR可能比HCCR更具挑战性。例如,空中手写字符缺少上/下笔信息,因为它总是以单个笔划结束。因此,由于字符中的笔画是用连字连接的,这可能在相似字符之间带来歧义。最后,由于提供者短缺和记录库存质量低下,很难为IAHCCR收集大量的训练数据。

IAHCCR的传统方法主要着重于设计(i)更好的手工特征(例如八向图和高阶方向)或(ii)较强的分类器(例如修改后的二次判别式)函数(MQDF)和基于稀疏表示的分类(SRC))。特别是,针对优化原型分类器(LSROPC)采用局部敏感的稀疏表示的方法在高阶方向性特征图上,IAHCCR取得了最先进的识别性能。随着卷积神经网络(CNN)的出现及其在图像分类方面的卓越性能,CNN已成功应用于HCCR / IAHCCR。通常,这种基于CNN的方法大大优于传统方法。

尽管CNN对于HCCR / IAHCCR取得了相当不错的识别性能,但它通常被参数化,并包含许多冗余的过滤器和参数。这导致它严重浪费了计算资源,包括电能,运行时的内存和存储空间。这些缺点使得在手机,智能电视和微型机器人等资源受限的设备上部署深度CNN模型具有挑战性。因此,构建具有(空中)手写识别竞争性能的非常紧凑的CNN模型至关重要。近年来,已经提出了许多压缩CNN的算法,主要可以分为以下几类。

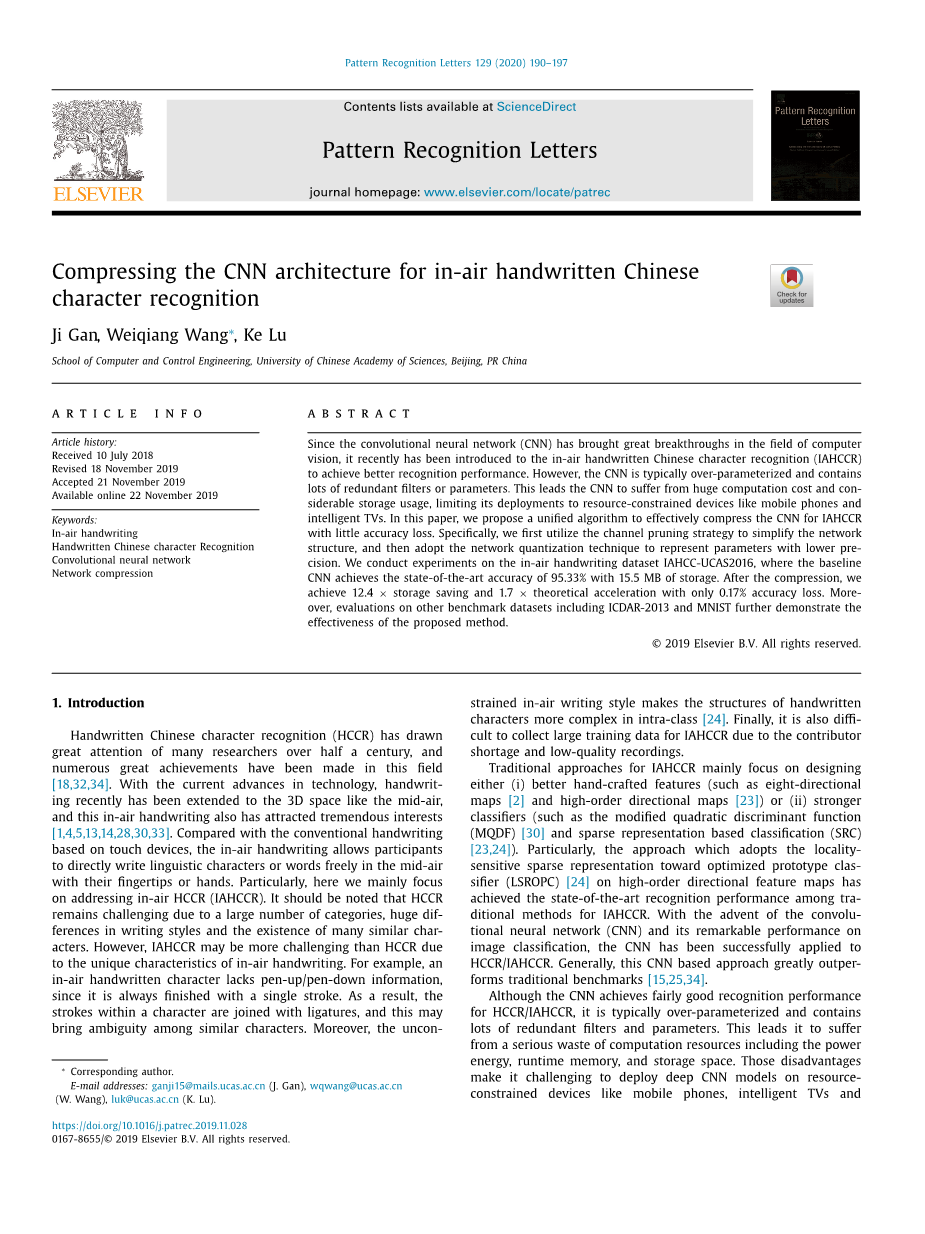

图1 提出的CNN压缩算法概述。该算法包括两个步骤:通道剪枝和网络量化。

网络剪枝。它指的是从原始网络中删除冗余结构(ig卷积通道)或参数。例如,提议剪枝网络中的冗余连接,即权重低于某个阈值的将被从模型中删除。但是,除非利用专门设计的硬件/算法,否则该方法不会减少计算成本或运行时内存。另一种有效的方法是在通道级别上剪枝权重,这会根据某些标准直接删除最不重要的通道,例如最小权重总和,平均零百分比(APoZ)和泰勒估计,将网络缩小为更薄的网络。通道剪枝的最大优点是它对实现和硬件都友好,不需要特殊的硬件/库。

网络量化。它主要分为两种类型。第一个直接将经过预处理的全精度(即32位浮点)权重转换为具有较小精度损失的低位表示形式,例如二值化,特纳化和二的幂次方。另一个将权重聚类为几个组,其中同一组共享相同的值,同时,在量化过程(例如深度压缩)中更新自适应码本。

其他技术。还提出了其他技术(例如低秩分解和紧凑模型设计)来从不同角度压缩网络。

但是,大多数以前的作品仅从他们各自的方面压缩网络,而只有少数作品已将这些孤立的算法组合在一起,以实现完整的网络压缩。此外,这些方法最初是用于图像分类的,但是非常有限的研究已经研究了它们对诸如IAHCCR之类的其他挑战性问题的可行性或有效性。与图像分类相比,IAHCCR面临更严峻的挑战,包括大类(约3811个类),相似字符的存在,其单笔书写风格引起的歧义以及训练样本不足。在这种情况下,尚未探索或验证IAHCCR的网络压缩的有效性。此外,IAHCCR的先前工作大部分都集中在提高手写字符的识别性能上,而没有人尝试为此任务设计非常紧凑的模型。

在本文中,我们提出了一种统一的算法来压缩IAHCCR的CNN,而不会明显降低识别性能。如图1所示,我们的算法利用了信道剪枝和网络量化的优势。对于通道剪枝,我们从原始网络结构中删除了最不重要的功能图及其相关的过滤器。此外,提出了一种简单的贪婪算法来迭代剪枝网络,当精度开始显着降低或达到所需的剪枝率时,该算法能够终止剪枝过程。对于网络量化,采用权重下降技术,在开始时使用来剪枝冗余参数以获得稀疏结构。然后,将所有权重以增量过程量化为低位表示形式,从而可以有效地保留原始模型的识别性能。实验是在基准数据集IAHCC-UCAS2016上进行的,其中CNN基线模型以15.5 MB的存储容量达到了95.33%的最新精度。压缩后,它可以节省12.4倍的存储空间和1.7倍的理论加速度,而精度损失仅为0.17%,即压缩的CNN可以达到95.16%的精度,而运行速度更快,仅需要1.2 MB的存储空间。

本文的其余部分安排如下。第2节介绍了提出的压缩算法,包括信道剪枝和权重量化。第三节介绍了实验结果和相关分析。最后,第4节总结了论文。

第二章 方法

如图1所示,所提出的方法包括通道剪枝和网络量化。在本节中,我们将详细描述每个部分。

2.1通道剪枝

CNN通常会被过度参数化,并且可以安全地剪枝其许多冗余卷积滤波器。通过直接删除冗余功能图,将网络缩减为更薄的网络,通道剪枝可简化网络架构。如图2所示,如果从当前层中删除了特定的通道(或要素图),则应该同时删除其对应的过滤器和下一层的相关过滤器。但是,从预处理的模型中随机剪枝通道可能会删除一些重要的权重。结果,剪枝后的CNN会遭受明显的精度下降,并且无法通过微调恢复其性能。因此,信道剪枝应遵循良好的标准,以删除最不重要的特征图,从而仅需进行几次微调即可保留剪枝后的网络的准确性。

图2 从给定的CNN架构中的卷积层剪枝信道(或特征图)

对于剪枝方案,由于很难从这种剪枝的模型中恢复原始精度,因此一口气从网络中剪枝掉一大块过滤器是非常危险的。此外,由于不同层的剪枝敏感性显着变化,因此也难以确定每个层的单独剪枝率。在本文中,我们提出了一种贪婪的剪枝算法,该算法通过使用粗精细再训练过程对整个网络过滤器进行剪枝。对于每一步,我们根据泰勒估计从网络中删除最多余的信道,然后通过很少的迭代就可以对网络进行粗调,以避免明显的精度损失。当准确性开始明显下降时,我们将对网络进行充分的重新训练以尽可能地恢复识别性能。如果(i)达到所需的剪枝率或(ii)无法通过足够的再培训恢复识别性能,则剪枝过程将终止。算法1中详细描述了完整的剪枝过程。

图3 说明我们的网络量化算法。在图中,量化权重的累积部分从50%到100%。对于k位量化,每个零值仅用1位存储,其余的k-1位存储可以表示2kminus;1个不同的非零值。

2.2网络量化

网络量化旨在将预处理的全精度(通常为32位浮点数)网络转换为具有低位表示形式的低精度版本,从而有效地减小存储大小。但是,如果将所有权重同时量化为低位表示形式,则会留出有限的空间来微调网络,因此会大大降低识别性能。为了解决这个问题,最近提出了增量网络量化(INQ)来有效避免相当大的精度损失。此外,我们进一步介绍了权重下降算法通过合并INQ获得更好的网络压缩。通常,我们的网络量化过程包括以下步骤:(1)权重下降(2)权重划分和增量量化。我们在图3中说明了设计的权重量化过程,并将详细描述每个步骤。

落锤。我们可以通过修剪冗余连接将密集网络转换为稀疏网络,即把低于给定阈值的权重设置为零。赋予所有权重W={w1,⋯,wi,⋯,wN},剪枝阈值Pdw由权重方差确定为

(1)

其中alpha;是超参数。特别地,应该凭经验选择alpha;,应该不仅有效地剪枝权重,而且还尽可能地保持原始精度。

权重量化。我们的权重量化采用可变长度编码方案。对于k位量化,我们仅使用1位来表示零值,其余部分用ķ-1位代表位2k-1个不同的非零值。给定全精度权重W,从固定码本中选择低精度权重Wl每个条目:

(2)

其中Delta;=2s-k 1个 和s=[log2(max(abs(W)))]。由于每个零值仅用一位表示,因此稀疏网络将比密集网络消耗更少的存储空间。

权重划分和增量量化。而不是一次性量化所有权重,而是使用增量量化策略。具体来说,我们首先根据权重的重要性将权重划分为两个不相交的组,即绝对值较大的权重更重要。然后我们量化第一组权重,并在所有量化权重固定的情况下重新训练其余组。根据,我们可以迭代地重复此过程,直到所有这些权重都被量化为止。最后,在算法2中详细描述了完整的量化过程。

2.3与以前方法的比较

如第1节所述,只有少数作品集合了不同的压缩策略来完全压缩CNN,例如[7]和[29]。在下面的部分中,我们将详细讨论该方法与以前方法的区别和优点。

具体来说,[7]提出了一种用于网络压缩的深度压缩算法,该算法由丢包权重和基于聚类的网络量化组成。但是,由于大多数参数

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[236437],资料为PDF文档或Word文档,PDF文档可免费转换为Word

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。