英语原文共 8 页

无人机着陆视觉系统

摘要

我们提出了一种实时计算机视觉系统的设计方案,该系统用于转子工艺无人驾驶飞行器着陆到已知的着陆目标上。该视觉系统由软件和现成的硬件组成,可执行图像处理,分割,特征点提取,摄像机摇摄/倾斜控制和运动估计。我们介绍了着陆目标的设计,它明显简化了角点检测和通信匹配等计算机视觉任务。开发了Ous tomized算法,以允许以30Hz的帧速率进行实时计算。这样的算法包括用于基于模型的相机姿态估计的某些线性和非线性优化。我们展示了实际飞行测试的结果,该测试表明基于视觉的状态估计是准确的每个平移轴在5厘米内,每个旋转轴5度,使视觉成为一个可行的传感器,放置在分层飞行管理系统的控制回路中。

1 介绍

计算机视觉作为廉价,被动和信息丰富的资源正在变得越来越重要,它补充了用于控制无人驾驶航空飞行器(UAV)的传感器套件。无人机上的视觉系统通常增强了传感器套件,其可能包括全球定位系统(CPS),[导航传感器(INS),激光测距仪,数字罗盘和声纳。任何实时视觉系统的设计都是一项艰巨的任务:它涉及系统的硬件集成,低级图像处理(如分割和特征提取);多视图几何(例如姿势和e:结构估计)和实时控制器的合成,因为其结构化的性质,非常着陆的任务是基于视觉的状态估计和控制,并且最近成为研究的一个活跃话题。在给定相机的缩放正投影模型的情况下,呈现用于估计相对于已知对象的姿势。为了估计UAV相对于着陆垫的位置和方向的目的,提出了在地标上使用平行线的消失点。由于他们的技术依赖于平行线的消失点,因此他们的算法对噪声最敏感并且最差。在最重要的时候进行估计:当DAV直接位于垫上时。在本文中,我们介绍了转子工艺实时视觉系统的设计和实现DAV估计其相对于30Hz的已知着陆目标的姿势和速度。我们的视觉系统使用定制的视觉算法和现成的硬件实时执行:图像处理,分段,特征点提取,摄像机控制,以及基于模型的姿态估计的线性和非线性优化。在我们的DAV测试台上进行的实际飞行测试表明,我们基于视觉的状态估计精确到每个平移轴5厘米以内,每个旋转轴5度,使其成为一个可行的传感器放置在一个控制回路中。分层飞行管理系统。

论文概要:第2部分详细描述了我们视觉系统的每个组成部分。第3节介绍了实际飞行实验的系统集成细节和实验结果,第4部分给出了有关研究的结论和方向。

2 视觉系统软件设计

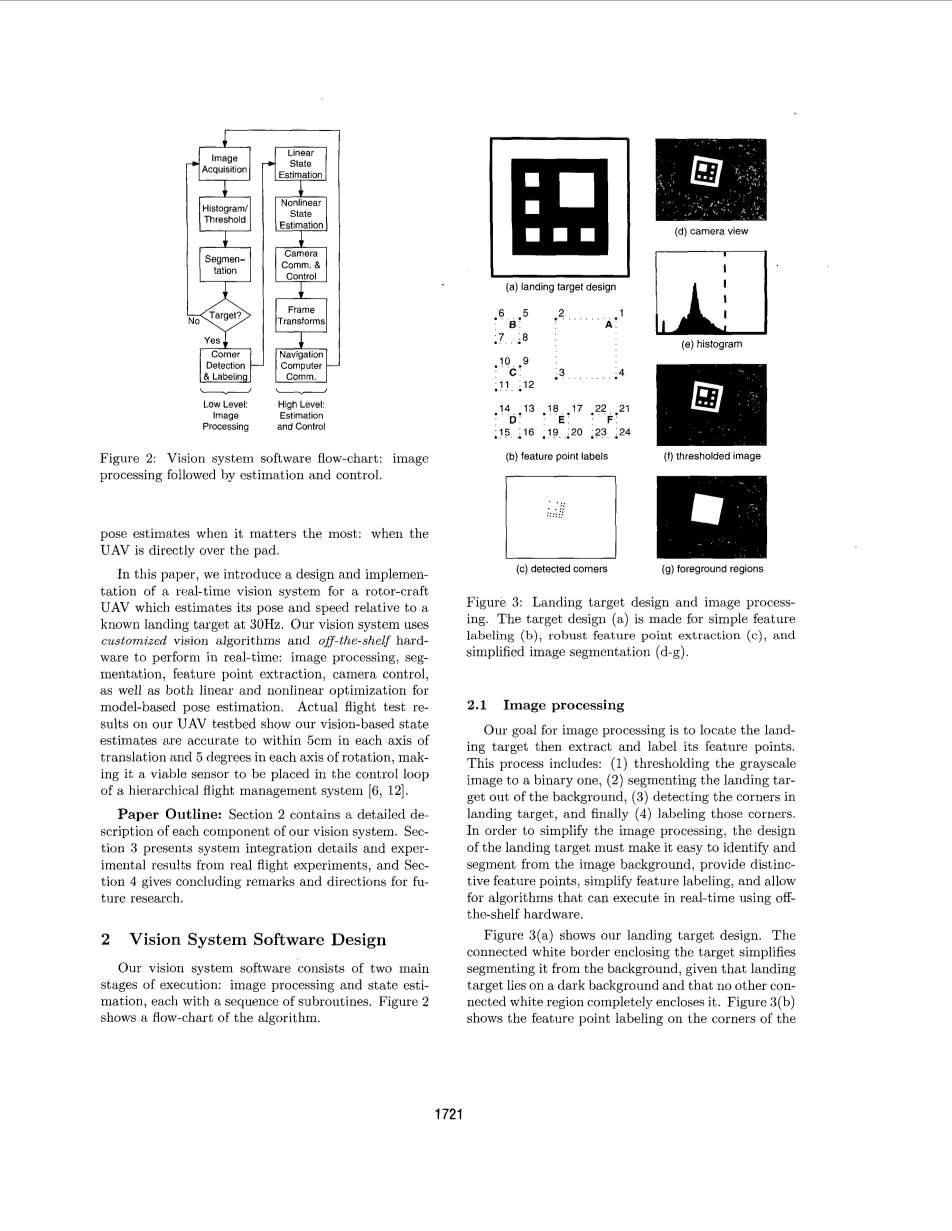

我们的视觉系统软件包括两个主要的执行阶段:图像处理和状态估计,每个阶段都有一系列子程序。

2.1 图像处理

我们的图像处理目标是找到着陆目标,然后提取并标记其特征点。该过程包括:(1)将灰度图像阈值化为二进制图像,(2)将着陆焦油分离出背景,(3)检测着陆目标中的角落,最后(4)标记这些角落。为了简化图像处理,着陆目标的设计必须使其易于从图像背景中识别和分割,提供不同的特征点,简化特征标记,并允许使用关闭实时执行的算法货架硬件。封闭目标的连接白色边界简化了将其从背景中分割出来,因为着陆目标位于黑暗的背景上,并且没有其他连接的白色区域完全包围它。着陆目标的内部白色正方形。我们选择角点检测优于其他形式的特征点,因为它简单,强大,并且每个图像像素区域提供高密度的特征点。我们在其他n边多边形上选择正方形,因为它们在每个投影投影和像素量化下最大化角的质量。此外,我们在焦油得到的方格的特定组织允许欧几里德运动和透视投影的直接特征点匹配不变,如“特征标记”部分所示。还探索了颜色跟踪作为特征点的提示,但是由于户外照明条件的变化,我们发现颜色跟踪不够稳健。

- 阈值。阈值算法必须产生二进制图像,使得着陆目标的黑色和白色区域被保留,并且主图像背景被连接并且是黑色的。我们发现最佳案例质量和整体稳健性之间最容易接受的算法是最简单的算法之一:基于最小和最大灰度级之间固定百分比的图像阈值。图3(d)至图3(f)给出了在来自车载摄像机的实际图像上测试的该阈值方案的结果。

- 分割。给定如图3(f)所示的二值图像,我们的分割阶段必须将着陆目标与背景分开并返回内部正方形。我们通过基于4连通性的标准连接组件标记算法[3]的两个连续通过来对着陆目标进行分段。第一遍将背景识别为最大的黑色成分(见图3(g))。第二遍将着陆目标识别为具有七个白色分量和一个黑色分量的单个前景区域。

- 角点检测。我们面临的角点检测问题是高度结构化的:我们需要检测二进制图像中的4边多边形的角。问题的结构化特性使我们能够避免通用角落检测器的计算成本。我们的角点探测器的基本不变量是在欧几里德运动和透视投影下保持凸性。这意味着对于穿过凸多边形内部的线,多边形中具有距线的每一边的最大距离的点集包含多边形的至少两个不同角。为了找到4边多边形的两个任意角,我们计算每条边的垂直距离指向穿过多边形重心的垂直线。如果在线的一侧有多个具有最大距离的点,我们选择距离重心最远的点。然后我们找到第三个角作为连接前两个角的线的最大距离点。最后,我们发现第四个角是多边形的点,与前三个角定义的三角形的距离最大。图3(c)显示了我们的角点检测算法在样本图像上的输出。

- 功能标签。我们的功能标签算法基于以下属性。对于某些包含平面P的点q1 , q2 , q 3 E] R,3,考虑矢量之间的最小幅度角度0(q2-q1)和(q:,, - q1 ) , 其中0gt; 0在观察时是CCWP的一些表面侧给定从P的同一侧取得的点q1,q2,q3的任何图像,如果0#39;是这些点的图像中的对应角度,则sign(0#39;)= sign(0)。这个属性保证了cor基于特征点的顺时针排序的响应匹配将适用于那些特征点的任何给定图像。我们的特征标记算法包括两个步骤:首先,每个方格基于其重心唯一识别,然后每个方格内的角被识别,如图3(b)所示。我们用方形D的标识开始标记目标的正方形。对于每个正方形,我们计算其中心与其他正方形中心之间的向量。我们将方形D识别为具有两对共线矢量的正方形。我们通过从正方形D排序来识别剩余的正方形。最后,我们将与正方形D的共线矢量相关联的正方形与它们的距离进行排序。为了完成特征标记过程,我们在类似的rnanner中识别每个方块的角。

2.2 姿势估计

(1) 平面特征的几何。给定la beled特征点,估计UAV状态是来自计算机视觉的所谓的基于模型的相机姿态估计问题。我们将线性和非线性优化算法应用于此问题。线性优化算法具有全局鲁棒性,但对噪声敏感。非线性优化算法需要充分的初始化,但对噪声更稳健。因此,我们通过首先求解线性问题并使用这些结果来初始化非线性算法来解决相机姿态估计问题。关于着陆垫中的点的等式通过等式给出相机头框架中该点的图像的坐标系

其中Ai E lR是未知尺度,Xi E lR3 是图像平面中特征点的坐标坐标,AE lR:x 3是摄像机校准矩阵,P = [I 0] E JRx 4是投影矩阵,g E SE(3)是着陆垫坐标系和欧几里德运动之间的均匀表示。相机头框架和qi E lR4 是世界上该点的同源代表。使用校准的针孔模型进行摄像机的透视投影,不失一般性,我们设置A = hx:1,然后缩放项Ai由下式给出:

其中e:1 = [0 0 1JI#39;E lR3 。等式(1)和(2)一起表示以下约束

我们从设计的着陆目标的几何学中了解每个气。角点检测算法提取图像帧中的每个特征点Xi。特征标记算法将每个相关联xi及其对应的气。根据这些数据,我们需要恢复相机姿势Pg = [R p],其中RE S0(3)是旋转,而P E JR3 是从着陆目标到摄像机头的平移。

- 线性优化。由于所有的功能点位于着陆目标的平面上,由于失去了一般性,我们可能选择了惯性公式纵坐标框使得所有i的eIQi = 0。以Qi = [Q; 1 Q; 2 qi3 1f,[R p] = [r1 r2 r3 p]

- 由于上述方程在[ri r2 p]中是线性的,我们可以将方程(4)重新组织成每个特征对应对(x;,q;)的向量形式,并叠加所有方程得到

通过对运动问题的平面结构上的众所周知的结果进行略微修改(参见例如Weng [13]),可以显示如果有至少有4个特征点,使得没有三个共线,然后秩(F)= 8.然而,由于角点检测中的噪声,实际上F总是满秩。因此,我们通过应用标准SYD技术来计算F的零空间的最小二乘估计计算奇异向量响应F的最小奇异值。给定着陆垫在摄像机前面的“正深度约束”,如果需要,我们否定SYD计算的正常向量结果以确保。接下来,我们通过计算给出f1和f2单位范数的向量[ff ff pT] T的比例因子来求解平移p E JR3 的尺度;即,p = 2p /(llf1II 1if211)-最后,我们从中求解旋转矩阵R.通过两个步骤估计f 1 和f 2 。首先,通过计算[f 1f 2 0] = U VT的SYD和设置,将矩阵[f1 f2 0] E JR3x 3投影到正交矩阵组0(3)上R = UVT。为了确保R是一个旋转矩阵,我们需要det(R)= 1.因此,如果我们的SYD计算得到det(UVT)= -1,我们翻转符号R的第三列向量,相当于设置R = uvrQ,其中Q = diag(1,1,-1)E]R3x3.在实践中,上述线性算法非常嘈杂,因为它估计了具有6个自由度的方程组的9个参数。然而,线性估计足够接近真实解决方案,以作为非线性优化技术的良好初始化。

(3) 非线性优化。非线性优化算法使重投影误差最小化G = [Gf··G ]TE lR2 其中Gi E lR2 由。给出

Gi = (x;ef - I)[R p]q;, (6)从右侧矩阵忽略最后一行的位置。旋转矩阵由ZYXEuler角度01,02 , 03 , 参数化,其中0;E(-1r,1r)和R = e“3s0 e”20 2e“10 1bull;非线性优化的估计参数为/ 3 = [0102 03 p 1 p2 p3] T.我们应用Newton Raphson方法的向量形式迭代求解/ J:其中kn是自适应步长,Df3G是雅可比行列式G的相对于/ 3,和(Df3Glf3)t是Df3Glf3-的Moore Penrose伪逆。

我们象征性地将Jacobian用于估计参数,并在运行时数值评估其值。f3o由线性估计的结果或最近的非线性估计(如果可用)初始化。我们自适应地选择kn以保证l [G(q,y,f3n)II对于连续的n单调减小。非线性算法优于线性算法,因为它仅优化了转换所需的6个参数。然而,由于非线性,有许多局部最小值。因此,该算法对初始化非常敏感,因此仅在广告“从线性算法初始化时才有用”。

3 系统集成和结果

(1) 硬件。作为BErkeley AeRobot(BEAR)项目[1]的一部分,我们的无人机试验台是我们安装的雅马

哈R-50直升机(见图1):bull; 导 航计算机: Pentium 233MHz Ampro LittleBoard运行QNX实时操作系统 - 可用于低水平飞行控制bull; 惯性测量单元:NovAtel MillenRT2 GPS系统(2cm精度)和波音DQI-NP INS / GPS集成系统bull; 视 觉计算机: Pentium 233MHz Ampro Lit tleBoard运行Linux - 负责抓取图像,视觉算法1和摄像机控制bull; 相机:索尼EVI-D30平移/倾斜/变焦相机

bull; 帧窗格: 图像 PXC200bull; 无线以太网:WaveLAN帧抓取器捕获30Hz的图像,这可以设置我们的视觉估计速率的上限。安装在UAV上的这种硬件的相互关系在图4中被触及。

(2) 相机控制。平移/倾斜摄像机的JProper控制可以增加UAV的运动范围,同时将着陆目标保持在摄像机头的视野中。我们使用的PTZ摄像机有一个内部控制器,可以通过串行链路命令相对或

绝对平移/倾斜位置。按照惯例,正平移移动图像中剩余的目标,正倾斜将目标向下移动到图像中。对于我们的相机,平移和倾斜的旋转轴与其光学中心重合。对于图像中的特定轴,如图5所示,轴上的点与轴的中心之间的角度由下式给出:

其中f是以弧度表示的轴的视场,d是以像素为单位的轴的宽度,p是投影到Lhe轴上的目标的像素位置。

现在,让目标的所需位置为(xo,Yo),目标位于(x1,Y1),图像宽度和高度为lx和ly,以及水平和垂直场视图是fx和f y-然后,使用等式(9),移动目标所需的摇摄和倾斜量到期望的位置是由

其中0pan和0tilt相对于当前的摇摄/倾斜状态。

- 帧转换。如图6所示,基于视觉的状态估计问题中涉及的坐标系和欧几里德运动的几何形状标记为:(a)着陆焦油得到,(b)着陆垫,(c)摄像头,(d) )摄像机底座,(e)无人机,(f)惯性机架。我们使用符号9ba E SE(3)来表示坐标框架b的欧几里德运动(平移和旋转)框架a。使用变换9ef和9 / b 仅用于评估视力算法的状态估计值,并且不直接用于视觉算法

- 软件。LAPACK(线性代数PACK年龄)和BLAS(基本线性代数子程序)[4]用于标准矩阵运算的视觉算法。在我们的分割算法中使用多分辨率方法来减少处理时间,有效地执行分割160 x 120图像。然后,从原始的320times;240图像计算着陆目标的内部正方形的边缘。我们开发了一个“地面站”,通过无线以太网与车载视觉计算机进行通信,并通过基于Java的GUI显示视觉系统的状态(如图7所示)。

- 飞行测试结果。对于飞行测试,无人机在一个小的静止着陆垫上方自动悬停,视觉系统实时运行。虽然视觉系统不影响对无人机的控制,但是同步地收集来自导航系统的状态估计以供稍后比较。图8显示了飞行测试的结果,将基于视觉的状态估计算法的输出与精确到2cm的INS / GPS测量值进行比较。所有图表都显示了UAV相对于着

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。