英语原文共 8 页,剩余内容已隐藏,支付完成后下载完整资料

U-Net:用于生物医学图像分割的卷积网络摘要

大量的观点认为,深度网络的成功训练需要数千个带标签的训练样本。在本文中,我们提出了一种网络和培训策略,它依赖强有力的数据增强来更有效地使用可用的标注样本。该体系结构由捕获上下文的合同路径和实现精确定位的对称扩展路径组成。我们表明,这样一个网络可以从极少数的图像端对端地进行训练,并且在ISBI挑战中胜过以前最好的方法(滑动窗口卷积网络),以分割电子微观堆栈中的神经元结构。在2015年,使用透射光显微镜图像(相差和DIC)训练的相同网络,我们在很大程度上赢得了这些类别的ISBI细胞追踪挑战2015。而且,网络速度很快。在最近的GPU上,512x512图像的分割需要不到一秒的时间。我们在http://lmb.informatik.uni-freiburg.de/people/ronneber/U-Net上提供完整的实施(基于Caffe)和受过训练的网络。

1、介绍

在过去的两年中,深卷积网络在许多视觉识别任务中超越了现有技术的水平,例如[7]。虽然卷积网络已经存在了很长时间[8],但由于可用训练集的大小和所考虑的网络的大小,它们的成功是有限的。 Krizhevsky等人的突破[7]是由于在ImageNet数据集上训练了一个具有8层和数百万个参数的大型网络,并有100万个训练图像。从那时起,更大和更深的网络已经被训练[12]。

卷积网络的典型用途是分类任务,其中图像的输出是单个类别标签。然而,在许多视觉任务中,尤其是在生物医学图像处理中,期望的输出应该包括定位,即应该将类别标签分配给每个像素。而且,在生物医学任务中通常无法获得数以千计的训练图像。因此,Ciresan等人[2]在滑动窗口设置中训练网络,通过在该像素周围提供局部区域(切片)来预测每个像素的类别标签作为输入。

首先,这个网络可以本地化。其次,切片产生的训练数据远大于训练图像的数量。由此产生的网络大幅度赢得了ISBI 2012的EM细分挑战。

显然,Ciresan等人的策略[2]有两个缺点。首先,它非常慢,因为网络必须分别为每个切片运行,并且由于切片重叠而导致大量冗余。其次,在本地化准确性和上下文的使用之间存在着贸易关系。较大的修补程序需要更多的最大值降采样层,以降低定位精度,而小修补程序允许网络只能看到很少的上下文。最近的方法[11,4]提出了一个分类器输出,它考虑了来自多个层的特征。良好的本地化和上下文的使用是可能的同时。

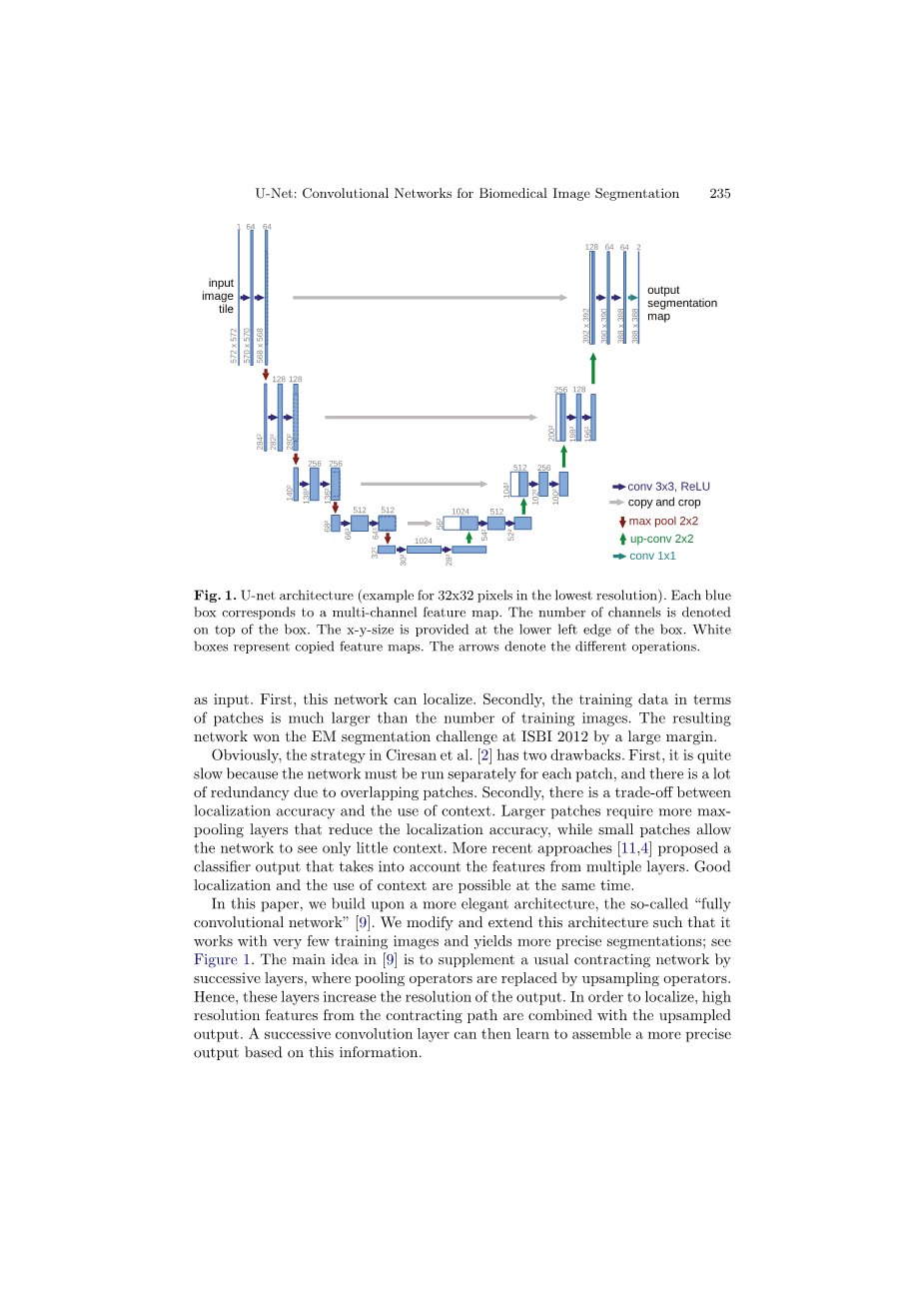

在本文中,我们建立在更优雅的架构上,即所谓的“完全卷积网络”[9]。我们修改和扩展了这个架构,使其能够在很少的训练图像下工作,并产生更精确的分割;参见图1. [9]中的主要思想是通过连续层来补充常用的承包网络,其中收缩网络被扩张网络所取代。因此,这些层增加了输出的分辨率。为了本地化,收缩路径中的高分辨率特征与上采样输出相结合。随后的连续卷积层可以学习根据这些信息组合更精确的输出。

我们架构中的一个重要修改是,在上采样部分,我们还有大量的特征通道,它们允许网络将上下文信息传播到更高分辨率的层。结果,扩张路径或多或少与收缩路径对称,并产生u形结构。该网络没有任何完全连接的层,并且仅使用每个卷积的有效部分,即,分割图仅包含像素,对于该像素,输入图像中的完整上下文是可用的。该策略允许通过重叠拼贴策略对任意大的图像进行无缝分割(参见图2)。为了预测图像的边界区域中的像素,通过镜像输入图像来推断丢失的上下文。这种平铺策略对于将网络应用于大图像很重要,否则分辨率将受到GPU内存的限制。

至于我们的任务,只有很少的训练数据可用,我们通过对可用的训练图像应用弹性变形来使用过多的数据增强。这使得网络能够学习这种变形的不变性,而不需要在注释图像语料库中看到这些变换。这在生物医学分割中特别重要,因为可以有效地模拟变形过程中组织和实际变形中最常见的变化。Dosovitskiy等人[3]在无监督特征学习的范围内证明了学习不变性的数据增强的价值。

许多细胞分割任务中的另一个挑战是分离相同类别的物体;参见图3.为此,我们提出使用加权损失,其中触摸单元之间的分离背景标签在损失函数中获得大权重。

由此产生的网络适用于各种生物医学分割问题。在本文中,我们展示了关于EM堆栈中神经元结构分割的结果(一项持续的竞争始于ISBI 2012),其中我们超过了Ciresan等人的网络。 [2]。此外,我们还展示了2015年ISBI细胞跟踪挑战的光学显微镜图像中细胞分割的结果。在这两个最具挑战性的2D透射光数据集中,我们赢得了很大的余地。

2、网络结构

网络架构如图1所示。它由一条收缩路径(左侧)和一条扩展路径(右侧)组成。收缩路径遵循卷积网络的典型体系结构。它由两次3x3卷积(unpadded convolutions)的重复应用组成,每次卷积后使用一个线性单元(ReLU)进行激活和一个2*2大小的最大池化操作,步进2用于下采样。在每个下采样步骤中,我们将特征通道的数量加倍。膨胀路径中的每一步包括对特征映射进行上采样,然后进行2x2卷积(“反卷积”),该特征映射将特征通道的数量减半,与收缩路径中相应裁剪的特征映射级联,以及两个3x3卷积,每个卷积都有一个ReLU激活函数。由于每个卷积中边界像素的丢失,裁剪是必要的。在最后一层,使用1x1卷积将每个64分量特征向量映射到期望数量的类。网络总共有23个卷积层。

为了实现输出分段映射的无缝平铺(请参见图2),选择输入切片大小非常重要,以便将所有2x2最大池操作应用于具有偶数x和y大小的图层。

3、训练

输入图像及其对应的分割图用于训练网络,其中随机梯度下降实现Ca ff e [6]。由于未卷积的卷积,输出图像比输入小一个恒定的边界宽度。为了最大限度地降低开销并最大限度地利用GPU内存,我们倾向于在较大批量的情况下使用较大的输入切片,从而将批量减少为单个图像。因此,我们使用高动量(0.99),以便大量先前看到的训练样本确定当前优化步骤中的更新。

能量函数是通过最终特征映射与交叉熵损失函数相结合的逐像素软最大值来计算的。软x最大定义为pk(x)= exp(ak(x))/ k k = 1 exp(ak(x))其中ak(x)表示特征通道k在像素位置xisin;Omega;与Omega;sub;Z2。 K是类的数量,而pk(x)是近似的最大函数。即pk(x)asymp;1对于所有其他k有最大激活ak(x)和pk(x)asymp;0的k。交叉熵然后在每个位置处惩罚p(x)(x)与1的偏差,使用E =xisin;Omega;w(x)log(p(x) →{1,...,K}是每个像素的真实标签,并且w:Omega;→R是我们引入的权重图,以给出一些像素在训练中更重要。

我们预先计算每个地面真实分割的权重图,以补偿训练数据集中某个类的像素的不同频率,并迫使网络学习我们在触摸单元之间引入的小分离边界(参见图3c和d)。

使用形态学操作计算分离边界。然后计算权重图

w(x)= wc(x) w0·exp- (d1(x) d2(x))22sigma;2(2)

其中wc:Omega;→R是平衡类频率的权重图,d1:Omega;→R表示到最近单元边界的距离,d2:Omega;→R到第二个最近单元边界的距离。在我们的实验中,我们设置w0 = 10和sigma;asymp;5像素。

在具有许多卷积层和通过网络的不同路径的深层网络中,权重的良好初始化非常重要。否则,网络的某些部分可能会导致过度激活,而其他部分则无法提供。理想情况下,应调整初始权值,使网络中的每个特征地图具有近似单位差异。对于具有我们的体系结构(交替卷积和ReLU层)的网络,可以通过从标准偏差为2 / N的高斯分布中绘制初始权重来实现,其中N表示一个神经元的输入节点数[5]。例如。对于前一层中的3times;3卷积和64个特征通道N = 9·64 = 576。

3.1数据增强

只有很少的训练样本可用时,数据增强对于训练网络所需的不变性和鲁棒性属性至关重要。在显微图像的情况下,我们主要需要移位和旋转不变性以及对变形和灰度值变化的鲁棒性。特别是训练样本的随机弹性变形似乎是训练具有很少注释图像的分割网络的关键概念。我们使用随机位移矢量在粗糙的3times;3网格上生成平滑变形。位移从10像素标准偏差的高斯分布中采样。然后使用双三次插值计算每像素位移。合同路径末端的退出层执行进一步的隐式数据增强。

4、实验

我们演示了U-Net在三种不同分割任务中的应用。第一项任务是电子显微镜记录中神经元结构的分割。数据集和我们获得的分割的一个例子显示在图2中。我们提供完整的结果作为补充材料。该数据集由EM分割挑战[14,1]提供,该分类挑战始于2012年ISBI,并且仍对新贡献开放。训练数据是来自果蝇第一龄幼虫腹神经线(VNC)的连续切片透射电子显微镜的一组30个图像(512x512像素)。每个图像都带有相应的完全注释的细胞(白色)和膜(黑色)的地面真实分割图。测试集是公开可用的,但其分割图是保密的。通过将预测的膜概率图发送给组织者可以获得评估结果。评估是通过对10个不同层次的地图进行阈值处理并计算“翘曲误差”,“兰德误差”和“像素误差”[14]来完成的。

U-Net(对输入数据的7个旋转版本进行平均)在没有进一步预处理或后处理的情况下达到0.0003529的翘曲误差(新的最佳得分,参见表1)和0.0382的随机误差。

这比Ciresan等人的滑窗窗口卷积网络结果要好得多。 [2],其最佳提交的翘曲误差为0.000420,兰德误差为0.0504。就rand错误而言,该数据集上唯一性能更好的算法使用高度数据集特定的后处理方法1应用于Ciresan等人的概率图。 [2]。

我们还将U-Net应用于光学显微图像中的细胞分割任务。该分段任务是ISBI单元跟踪挑战2014和2015的一部分[10,13]。第一组数据集“PhC-U373”2包含通过相差显微术记录的聚丙烯酰亚胺基质上的成胶质细胞瘤 - 星形细胞瘤U373细胞(参见图4a,b和补充材料)。它包含35个部分注释的训练图像。在这里,我们实现了92%的平均IOU(“交集超过联合”),明显好于83%的次优算法(见表2)。第二组数据集“DIC-HeLa”3是通过差分干涉对比(DIC)显微镜记录的玻璃上的HeLa细胞(参见图3,图4c,d和补充材料)。它包含20个部分注释的训练图像。在这里,我们获得77.5%的平均IOU,明显好于46%的第二优秀算法。

5、结论

U-Net架构在非常不同的生物医学分割应用中实现了非常好的性能。由于具有弹性变形的数据增强,它只需要很少注释的图像,并且在NVidia Titan GPU(6 GB)上的训练时间非常合理,只需要10个小时。我们提供全面的实施和训练有素的网络4。我们相信,U-Net架构可以轻松应用于更多的任务。

致谢

这项研究得到了德国联邦和州政府卓越计划(EXC 294)和BMBF(Fkz 0316185B)的支持。

参考文献:

1. Cardona, A., et al.: An integrated micro- and macroarchitectural analysis of the drosophila brain by computer-assisted serial section electron microscopy. PLoS Biol. 8(10), e1000502 (2010)

2. Ciresan, D.C., Gambardella, L.M., Giusti, A., Schmidhuber, J.: Deep neural networks segment neuronal membranes in electron microscopy images. In: NIPS, pp. 2852–2860 (2012)

3. Dosovitskiy, A., Springenberg, J.T., Riedmiller, M., Brox, T.: Discriminative unsupervised feature learning with convolutional neural networks. In: NIPS (2014)

4. Hariharan, B., Arbelacute;aez, P., Girshick, R., Malik, J.: Hypercolumns for object segmentation and fine-grained localization (2014), arXiv:1411.5752 [cs.CV]

5. He, K., Zhang, X., Ren, S., Sun, J.: Delving deep into rectifiers: Surpassing humanlevel performance on imagenet classification (2015), arXiv:1502.01852 [cs.CV]

6. Jia, Y., Shelhamer, E., Donahue, J., Karayev, S., Long, J., Girshick, R., Guadarrama, S., Darrell, T.: Caffe: Convolutional architecture for fast feature embedding (2014), arXiv:1408.5093 [cs.CV]

7. Krizhevsky, A., Sutskever, I., Hinton, G.E.: Imagenet classification with deep convolutional neural networks. In: NIPS, pp. 1106–1114 (2012)

8. LeCun, Y., Boser, B., Denk

全文共6730字,剩余内容已隐藏,支付完成后下载完整资料

资料编号:[12430],资料为PDF文档或Word文档,PDF文档可免费转换为Word

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。

您可能感兴趣的文章

- GIS矢量地图的鲁棒水印方案外文翻译资料

- 中国相似地理位置发达地区房价影响因素的差异——以西安高新区和沣渭新区为例外文翻译资料

- 集成数据在城市土地利用变化时空动态监测的应用——以印度金奈都市为例外文翻译资料

- 全球地表水及其长期变化的高分辨率制图外文翻译资料

- 造成沿海大型城市内涝灾害的主要因素识别——以中国广州为例外文翻译资料

- 基于SFPHD框架的中国快速城市化地区城市生态系统健康综合评价方法外文翻译资料

- 基于绿地演变的未来城市地表热岛强度的多情景模拟预测外文翻译资料

- 中国大陆272个城市地面和冠层城市热岛强度的长期趋势外文翻译资料

- 与孟加拉湾热带气旋有关的中国低纬度高原远距离降雨事件外文翻译资料

- 新丰江水库流域GPM IMERG降水产品评价及水文效用研究外文翻译资料