英语原文共 10 页,剩余内容已隐藏,支付完成后下载完整资料

时序动作提名生成的边界匹配网络

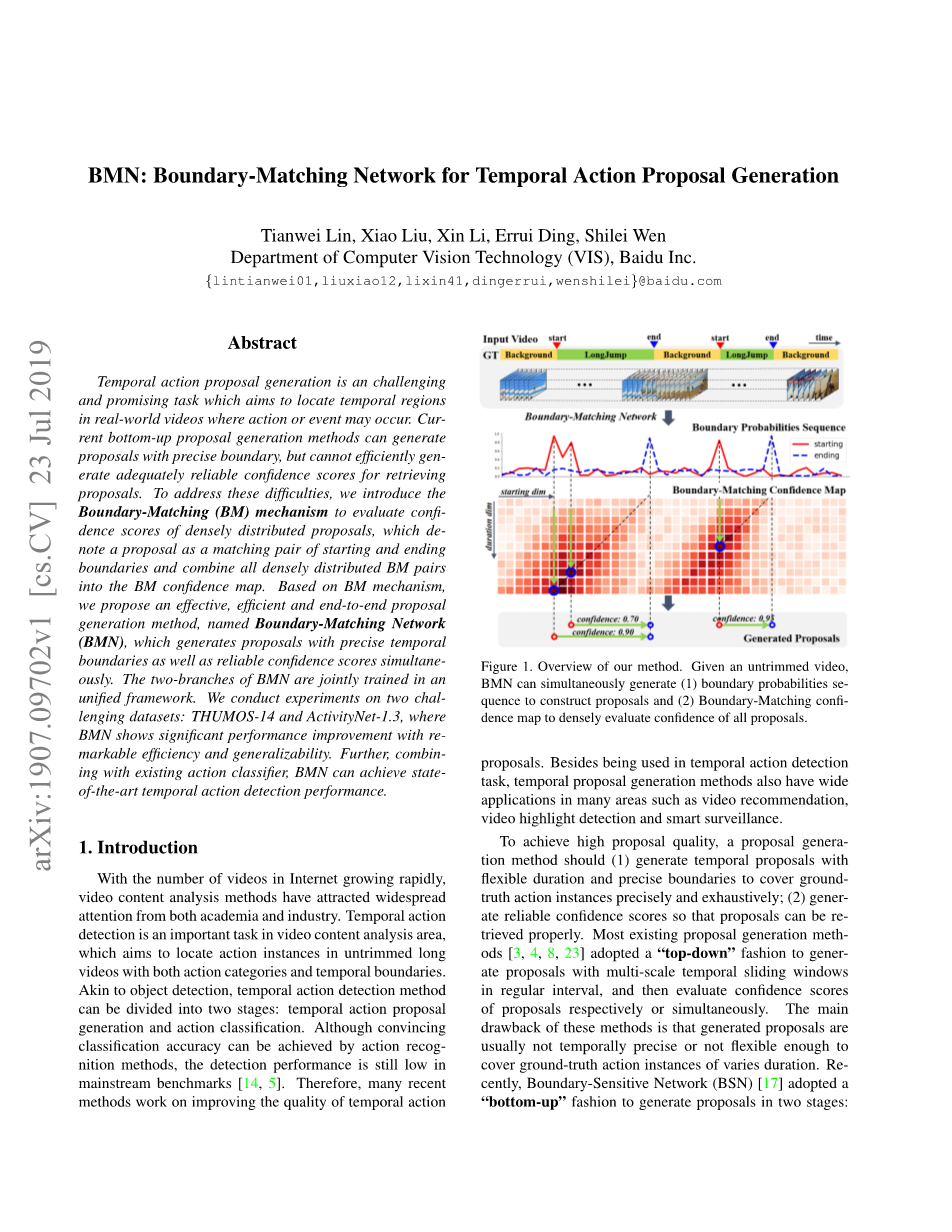

摘要:时序动作提名生成是一项具有挑战性和发展前景的任务,其目标是在真实视频中找出动作或事件可能发生的时间区域。目前自下而上的提名生成方法可以生成边界精确的提名,但不能有效地生成检索提名所需的足够可靠的信任评分。为了解决这些差异,我们引入了边界匹配(BM)机制来评估分布密集的提名的一致性得分,该机制将提名标记为一个匹配的开始和结束边界对,并将所有分布密集的BM对合并到BM证据图中。基于BM机制,我们提出了一种有效的、高效的端到端提名生成方法——边界匹配网络(BMN),该方法能够同时生成具有精确时间边界和可靠可信度评分的提名。BMN的两个分支在一个统一的框架中联合训练。我们在两个测试数据集:THUMOS-14和ActivityNet-1.3上进行了实验,结果表明,BMN表现出显着的性能提升,效率和通用性也非常高。此外,结合现有的动作分类器,BMN可以实现最先进的时间动作检测性能。

1.引言

随着网络视频数量的快速增长,视频内容分析方法受到了学术界和业界的广泛关注。时间动作检测是视频内容分析领域的一项重要工作,它的目标是在未裁剪的长视频中同时定位动作类别和时间边界的动作实例。与目标检测相似,时间动作检测方法也可以分为两个阶段:时间动作生成阶段和动作分类阶段。虽然可以通过动作识别方法实现分类精度,但主流基准的检测性能仍然较低[14,5]。因此,最近的许多方法致力于提高时序动作提名的质量。除了用于时态动作检测任务外,时序提名生成方法在视频推荐、视频高亮检测、智能监控等领域也有广泛的应用。

为了获得高质量的提名,提名生成方法应(1)生成具有灵活的持续时间和精确边界的临时建议书,以准确而详尽地涵盖标注数据实例;(2)生成可靠的信任评分,使提名能过被正确检索。现有的大多数提名生成方法[3,4,8,23]采用“自顶向下”的方式,定期间隔生成具有多尺度时间滑动窗口的提名,然后分别或同时评估提名的可信度得分。这些方法的主要缺点是生成的提名通常在时间上不够精确,或者不够灵活,无法覆盖持续时间不同的基本事实操作实例。最近,边界敏感网络(BSN)[17]采用了一种“自下而上”的方式,在两个阶段生成提名:(1)定位时间边界并将边界合并为提名,(2)利用构造的提名特征对每个提名的可信度评分进行评估。通过利用局部线索,BSN可以生成比现有自顶向下方法边界更精确、持续时间更灵活的提名。然而,BSN存在三个主要缺陷:(1)对每个提名分别进行提名特征构建和证据评估,导致效率低下;(2)在BSN中构造的提名特征太简单,无法捕获足够的时间上下文;(3)BSN是多阶段的,但不是一个统一的框架。

我们是否能在丰富的背景下同时评估所有提名的一致性?自顶向下的方法[18,2]可以很容易地通过锚点制实现这一目标,其中提名被预先定义为非连续的分布式锚点。但是,由于提名的边界和期限更加灵活,锚机制不适用于BSN等自下而上的方法。为了解决这些差异,我们提出了边界匹配(BM)机制来对密集分布的提名进行置信度评估。在BM机制中,提名被表示为其开始和结束边界的匹配对,然后将所有BM对组合为一个二维BM置信度图,以表示具有连续的开始边界和时间持续时间的密集分布的提名。通过BM置信度图同时为所有提名评分。BM层被用来从时间特征序列中生成BM特征图,并通过一系列的卷积层从BM特征图中获得BM置信度图。BM特征图包含每个提名的丰富特征和时间上下文,并提供了利用相邻提名的上下文的可能性。

总而言之,我们的工作主要有以下三个方面:

1.我们引入了边界匹配机制来评估密集分布的提名的置信度分数,该分数可以很容易地嵌入网络中。

2.我们提出了一种高效,有效且端到端的时序动作提名生成方法,名为边界匹配网络(BMN)。 在BMN的两个分支中同时生成时间边界概率序列和BM置信度图,它们作为一个统一框架共同训练。

3.大量的实验表明,与其他先进的方法相比,BMN能显著地提高提名生成性能,在时间动作检测任务中具有显著的效率、通用性和良好的性能。

图1.我们的方法概述。 给定未修剪的视频,BMN可以同时生成(1)边界概率序列以构建提名,以及(2)边界匹配置信度图以密集评估所有提名的置信度。

2.相关工作

动作识别。动作识别是视频分析领域的基础和重要任务。手工特征如HOG、HOF、MBH等在早期的作品中被广泛使用,如改进的稠密轨迹(iDT)[29,30]。近年来,深度学习模型在动作识别任务中取得了显著的绩效提升。主流网络分为两类:两流网络[9,24,32]分别利用RGB图像和叠加光流中的外观和运动线索;3D网络[27,21]直接从原始视频量中利用外观和动作线索。在工作中,按照惯例,我们采用动作识别模型来提取未修剪视频的视觉特征序列。

相关匹配。相关匹配算法广泛应用于图像配准、动作识别和双目立体匹配等计算机视觉任务中。具体地说,双目立体匹配就是从立体图像中寻找对应的像素。对于经过校正的图像对的左图像中的每个像素,立体匹配方法需要沿水平方向在右图像中找到对应的像素,或者说以最小的代价找到右图像的像素。因此,所有左像素扫描的成本最小化被表示为一个成本量,它表示每个左右像素对作为量中的一个点。最近的许多工作[26,20,16]都是基于代价量,利用相关层[20]或特征级联[6],将两个特征映射直接生成代价量,实现端到端网络。受成本量的启发,我们提出的BM置信度图包含成对的时间起点和终点边界作为提名,因此可以使用卷积层直接为所有提名生成置信度分数。我们提出了BM层,以通过在每个提名的开始和结束边界之间同时采样特征来有效地生成BM特征图。

时序动作提名生成。如前所述,时间动作检测任务的目标是在具有时间边界和动作类别的未修剪视频中检测动作实例,可将其分为时序提名生成阶段和动作分类阶段。在大多数检测方法中,这两个阶段是分开的[23, 25,35],并且在某些方法中被合并为单个模型[18,2]。对于提名生成任务,以往的大部分工作[3、4、8、12、23]都采用自顶向下的方式,对提名的持续时间和间隔进行预先设定,其主要缺点是缺乏边界精度和持续时间灵活性。TAG [35]使用时间分水岭算法(temporal watershed algorithm)生成提名,但缺乏用于检索的置信度分数。最近,BSN[17]通过局部定位时间边界和全局评估置信度分数来生成提名,并在之前的提名生成方法的基础上实现了显著的性能提升。在这项工作中,我们提出了一种用于提名置信度评估的边界匹配机制,该机制可以大大简化BSN的流程,并在效率和有效性方面都将带来显着的提升。

3.我们的方法

3.1问题表述

我们可以将未修剪的视频X使用来表示X的帧序列,其中表示视频的第n个RGB帧。X的时间注释(? temporal annotation)由一组时间动作实例组成,记为,其中表示是标注数据动作实例的数量,表示动作提名的开始时间,表示动作提名的结束时间。与时序动作检测任务不同,提名生成任务中不考虑动作实例的类别。在推论过程中,提名生成方法所生成的提名应该详尽和准确地覆盖提名。

3.2 功能编码

根据最近的提名生成方法[3、8、12、17],我们根据从原始视频中提取的视觉特征序列构建BMN模型。在这项工作中,我们采用双流网络[24]进行特征编码,因为它可以实现出色的动作识别精度,并被许多视频分析方法广泛使用[11、18、35]。结合双连接层中的全连接层的输出分数,我们可以得到围绕帧的视觉特征编码,其中C是特征的维数。因此,给定长度为的未修剪的视频X,我们可以提取长度为的视觉特征序列。为减少计算成本,我们以规定帧间隔提取特征,因此。

3.3 边界匹配机制

在本节中,我们介绍了边界匹配(BM)机制来为密集分布的提名生成置信度得分。首先我们将时序提名表示为其开始边界和结束边界的匹配对。然后,如图2所示,BM机制的目标是生成二维BM置信度图,该图由具有不同起始边界和时间持续时间的BM对构成。在BM执行图中,点的值表示为提名的置信度分数,持续时间为,结束边界为。因此我们可以通过生成BM置信度图来生成密集分布的提名的置信度分数。

图2。BM置信度图说明。同一行的提名具有相同的时间期限,同一列中的提名具有相同的启动时间。右下角建议的结束边界超出了视频的范围,因此在训练和推理时不考虑这些建议。

图3. BM层示意图。 对于每个提名,我们在采样权重和时间特征序列之间的T维上进行点积运算,以生成形状Ctimes;N的BM特征。

边界匹配层。 我们如何从时间特征序列中生成二维BM置信度图?在BM机制中,我们引入BM层从时间特征序列来生成BM特征图,然后使用来生成具有一系列卷积层的BM置信度图,其中D是预先定义的最大提名持续时间。BM层的目标是在每个提名的开始边界和结束边界之间均匀采样中的N个点。然后得到具有丰富上下文的提名特征。通过同时针对所有提名执行此采样过程,我们可以生成BM特征图。

实现此特征采样过程有两个困难:(1)如何在非整数点中对特征进行采样;(2)如何同时对所有提名的特征进行采样。如图3所示,我们通过时序特征序列和采样掩码权重在时间维度上的点积来实现这一点。具体地说,首先对于每个提名,我们通过在扩展的时间区域之间均匀采样N个点来构造权重项。对于非整数采样点,我们将其对应的采样掩码定义为如下:

其中dec和floor是分别为小数和整数小数的函数。因此,对于提名我们可以得到权重项。其次,我们在时间维度上对和进行点积。

通过将BM置信度图中所有提名的扩展为,我们可以使用点积运算生成BM特征图。由于不同视频的采样掩模权值W是相同的,可以预生成,所以BM层的推理速度非常快。BM特征层包含了每个提名丰富的特征和时间上下文,为相邻提名的上下文挖掘提供了可能。

边界匹配标签。在训练期间,我们将BM标签图(BM label map)表示为,具有相同形状的BM置信度图,其中表示提名和所有标注数据实例之间的最大重叠度(IoU)。通常,在BM机制中,我们使用BM层从时序特征序列来有效地生成BM特征图,然后使用一系列的卷积层来生成BM置信度图,并在BM标签图的监督下对其进行训练。

表1. BMN的详细体系结构,其中基本模块的输出功能序列由时间评估和提名评估模块共享。 T和D分别是输入要素序列的长度和最大提名持续时间。

3.4 边界匹配网络

与BSN [17]的多阶段框架不同,BMN同时生成局部边界概率序列和全局提名置信度图,而整个模型在统一框架中训练。如图4所示,BMN模型包含三个模块:基本模块处理输入特征序列,并输出以下两个模块共享的特征序列;时间评估模块评估视频中每个位置的开始和结束概率以生成边界概率序列; 提名评估模块包含BM层以将特征序列转换为BM特征图,并包含一系列3D和2D卷积层以生成BM置信度图。

图4.边界匹配网络框架。 特征提取后,我们使用BMN同时生成时间边界概率序列和BM置信度图,然后基于边界概率构造建议,并从BM置信度图中获得相应的置信度得分。

基本模块。基本模块的目标是处理输入特征序列,扩展接受域并充当网络的骨干,为TEM和PEM提供共享的特征序列。由于未修剪的视频具有不确定的时间长度,因此我们采用长度为的长观察窗来截断长度为的未修剪特征序列。我们将观测窗口表示为,其中和分别是的开始和结束时间,和分别是窗口内的注释和特征序列。窗口长度取决于数据集,基本模块的详细信息如表1所示,包括两个时间卷积层。

时间评估模块(TEM)。TEM的目标是评估未修剪视频中所有时间位置的开始和结束概率。 这些边界概率序列用于在后处理期间生成提名。TEM的细节如表1所示,具有两个sigmoid激活过滤器的层分别为观察窗口输出起始概率序列和结束概率序列。

提名评估模块(PEM)。 PEM的目标是生成边界匹配(BM)置信度图,其中包含密集分布的提名的置信度分数。 为此,PEM包含BM层以及一系列3d和2d卷积层。

正如3.3的第二节所示,BM层通过S与时间维度上的采样掩模权重W之间的矩阵点积将时间特征序列S转换为BM特征图。在BM层中,采样点数N设置为32,最大建议持续时间D取决于数据集。生成BM特征图后,首先对样本进行层,将维度从N将为1,并将隐藏单元从128增加至512。然后对使用核的来减少隐藏单元,使用核的来捕获相邻提名的上下文。最后,我们生成了两类具有sigmoid型激活的BM置信度图,,其中和分别使用二进制分类和回归损失函数进行训练。

3.5 BMN训练

在BMN中,TEM学习局部边界上下文和PEM模式全局提名上下文。为了共同学习局部模式和全局模式,采用了一个统一的多任务框架进行优化。

训练数据构建。 给

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[236097],资料为PDF文档或Word文档,PDF文档可免费转换为Word

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。