英语原文共 12 页,剩余内容已隐藏,支付完成后下载完整资料

Received April 20, 2014, accepted May 13, 2014, date of publication May 16, 2014, date of current version May 28, 2014.

Digital Object Identifier 10.1109/ACCESS.2014.2325029

大数据深度学习:挑战与展望

XUE-WEN CHEN1 , (Senior Member, IEEE), AND XIAOTONG LIN2

1Department of Computer Science, Wayne State University, Detroit, MI 48404, USA

2Department of Computer Science and Engineering, Oakland University, Rochester, MI 48309, USA

Corresponding author: X.-W. Chen (xwen.chen@gmail.com)

摘要 深度学习是当前机器学习和模式识别领域中一个非常活跃的研究领域。它在语音识别、计算机视觉、自然语言处理等广泛的应用领域取得了巨大的成功。随着当今数据的巨大规模,大数据给各个行业带来了巨大的机遇和变革潜力;另一方面,它也给数据和信息的利用带来了前所未有的挑战。随着数据越来越大,深度学习在提供大数据预测分析解决方案方面发挥着关键作用。本文对深度学习进行了简要的概述,并重点介绍了当前的研究工作、大数据面临的挑战以及未来的发展趋势。

关键字 分类器设计与评估、特征表示、机器学习、神经网络模型、并行处理

I.emsp;引言

深度学习和大数据是快速增长的数字世界中两个最热门的趋势。虽然对大数据的定义各不相同,但这里所指的是数字数据的指数增长和广泛可用性,这些数据很难或甚至不可能使用传统的软件工具和技术进行管理和分析。各种形状和大小的数字数据正以惊人的速度增长。例如,据国家安全局称,互联网每天处理1826千兆字节的数据[1]。2011年,数字信息在短短5年内增长了9倍[2],到2020年,全球数字信息量将达到35万亿GB[3]。数字数据的爆炸性增长为企业、医疗保健行业制造业和教育服务业等各个行业带来了巨大的机遇和变革潜力[4]。这也导致我们的科学研究向数据驱动的发现发生了巨大的范式转变。

虽然大数据为我们社会的各个方面带来了巨大的变革潜力,但从大数据中获取有价值的知识并不是一项普通的任务。隐藏在史无前例的非传统数据中的庞大而迅速增长的信息体需要先进技术的发展和跨学科团队的密切合作。今天,机器学习技术,加上现有计算能力的进步,已经在大数据分析和知识发现中发挥了至关重要的作用(见[5]-[8])。它们被广泛用于利用大数据在搜索引擎、医学和天文学等领域的预测能力。作为机器学习的一个非常活跃的分支,深度学习与大数据一起被认为是“美国创新和经济革命的大交易和基础”[9]。

与大多数被认为使用浅层结构学习架构的传统学习方法相比,深层学习是指使用有监督和/或无监督策略自动学习深层结构中用于分类的分层表示的机器学习技术[10]、[11]。受人类大脑处理自然信号机制的生物学观察启发,深度学习近年来因其在语音识别[12]、[13]、[14]和计算机视觉[15]、[16]等许多研究领域的最新表现而备受学术界关注。深度学习也成功地应用于利用大量数字数据的工业产品中。像谷歌、苹果和Facebook这样每天收集和分析大量数据的公司,一直在积极推进与深度学习相关的项目。例如,苹果的Siri是iphone中的虚拟个人助理,它利用苹果服务收集的深入学习和越来越多的数据,提供各种各样的服务,包括天气预报、体育新闻、用户问题解答和提醒等[17]。谷歌将深度学习算法应用于从互联网上获取的海量凌乱数据,用于谷歌的翻译、Android的语音识别、谷歌的街景和图像搜索引擎[18]。其他行业巨头也不甘落后。例如,微软在Bing语音搜索中的实时语言翻译[19]和IBM的大脑型计算机[18],[20]使用诸如深度学习等技术来利用大数据获取竞争优势。

随着数据不断增长,深度学习在提供大数据预测分析解决方案方面将发挥关键作用,特别是随着处理能力的提高和图形处理器的进步。本文的研究目标不是对深度学习的所有相关工作进行全面的综述,而是主要探讨与海量数据学习相关的最重要问题,突出当前的研究工作和对大数据的挑战,以及未来的发展趋势。论文的其余部分安排如下。第2节简要回顾了两种常用的深度学习体系结构。第3节探讨了从海量数据中进行深度学习的策略。最后,我们在第4节讨论了大数据深度学习的挑战和前景。

II.emsp;深度学习概述

深度学习是指在深度架构中学习多层次表示的一组机器学习技术。在这一节中,我们将简要介绍两种成熟的深层结构:深度置信网络(DBNs)[21]-[23]和卷积神经网络(CNNs)[24]-[26]。

A.ensp; 深度置信网络

传统的神经网络容易陷入非凸目标函数的局部最优,这往往导致性能不佳[27]。此外,他们不能利用未标记的数据,这些数据往往是丰富和廉价的大数据收集。为了缓解这些问题,深度置信网络(DBN)使用了一个深度架构,该架构能够从呈现给它的标记数据和未标记数据中学习特征表示[21]。该方法结合了无监督预训练和监督微调策略来构造模型:无监督阶段不使用标签信息来学习数据分布,监督阶段进行局部搜索以进行微调。

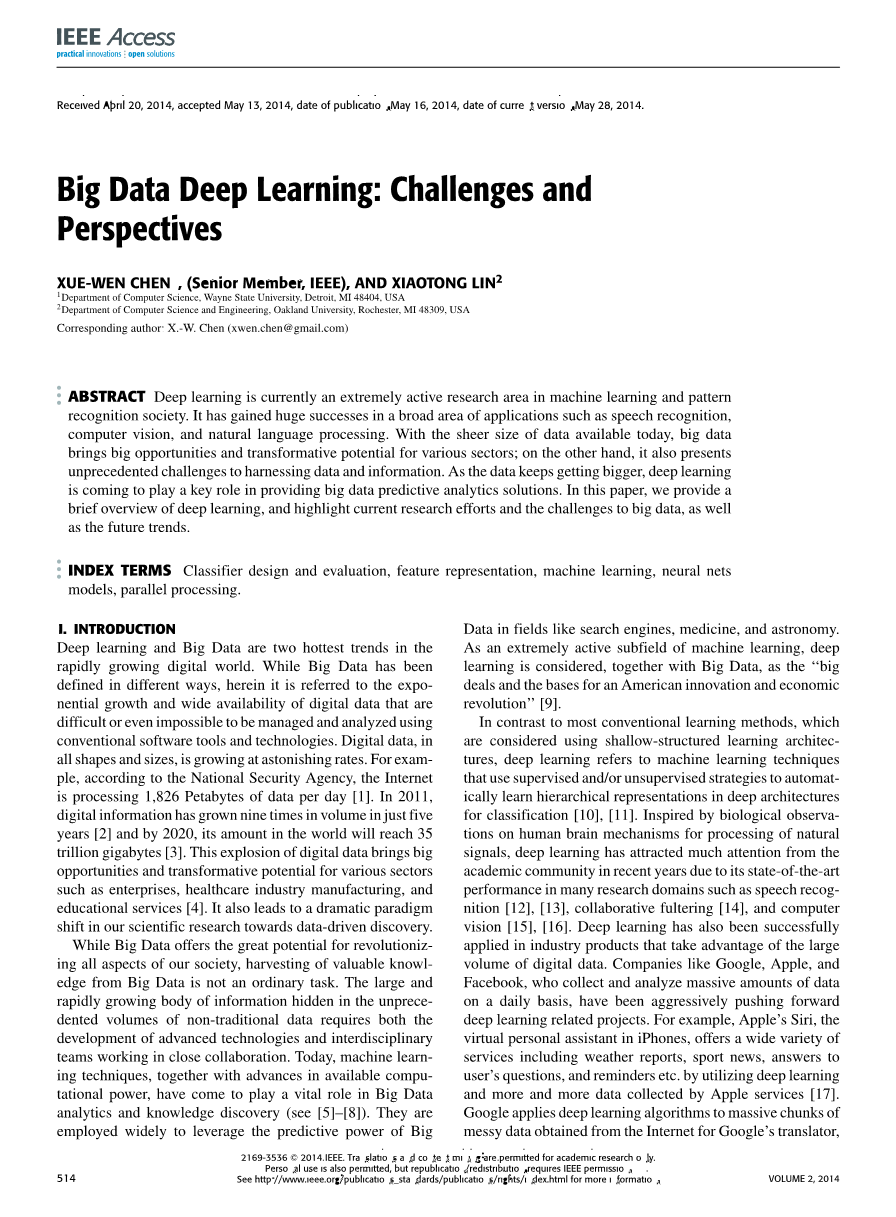

图1示出了典型的DBN架构,该架构由一堆受限Boltzmann机器(RBMs)和/或用于判别任务的一个或多个附加层组成。RBMs是一种概率生成模型,它不需要使用数据标签就可以学习观测(训练)数据的联合概率分布[28]。它们可以有效地利用大量未标记的数据来开发复杂的数据结构。一旦确定了DBN的结构,训练的目标就是学习层之间的权重(和偏差)。这首先由RBMs的无监督学习进行。典型的RBM由两层组成:一层中的节点与另一层中的节点完全连接,而同一层中的节点没有连接(参见图1,例如,输入层和第一隐藏层H1构成RBM)[28]。因此,给定另一层中的所有节点,每个节点都独立于同一层中的其他节点。这个特性允许我们使用Gibbs抽样训练每个RBMs的生成权重W[29],[30]。

图 1. 深度置信网络架构图示。这个特定的DBN由三个隐藏层组成,每个隐藏层有三个神经元;一个输入层有五个神经元,一个输出层也有五个神经元。任何两个相邻的层都可以形成一个用未标记数据训练的RBM。当前RBM的输出(例如,第一RBM中的hi(1)标记为红色)是下一RBM的输入(例如,第二RBM中的hi(2)标记为绿色)。然后在训练前用标记的数据对权重W进行微调。

在微调之前,对RBM进行逐层的预训练:将RBM的输出作为下一个RBM的输入,并重复该过程,直到对所有RBM进行预训练。这种逐层无监督学习在DBN训练中是非常关键的,因为它有助于避免局部最优,并缓解在使用数百万个参数时观察到的过拟合问题。此外,该算法在时间复杂度方面是非常有效的,它与RBMS(21)的数量和大小是线性的。不同层次的特征包含了不同的数据结构信息,其中高层特征是由底层特征构成的。注意,叠加rbm的数量是用户预先确定的参数,并且预训练只需要未标记的数据(为了更好的泛化)。

对于可见层和隐藏层均为伯努利分布的简单RBM,采样概率如下[21]:

其中v和h分别表示I times;1可见单位向量和J times;1隐藏单位向量;W是连接可见层和隐藏层的权重矩阵(wij);aj和bi是偏差项;sigma;(bull;)是一个sigmoid函数。对于实值可视单元,条件概率分布略有不同:通常假设高斯-伯努利分布,p(vi|h;W)为高斯分布[30]。

权重 wij 基于一种近似方法称为对比散度(CD)逼近[31]。例如,wij的第(t 1)个权重可以更新如下:

其中alpha;是学习率,c是动量因子;lt;bull;gt;data和lt;bull;gt;model分别是数据和模型定义的分布下的期望值。虽然期望值可以通过无限多次运行Gibbs采样来计算,但实际上,通常使用一步CD,因为它的性能很好[31]。其他模型参数(如偏差)也可以类似地更新。

作为一种生成模式,RBM训练包括一个Gibbs采样器,根据可见单元对隐藏单元进行采样,反之亦然(Eqs)。(1) 和(2)。然后使用CD规则(等式3)更新这两层之间的权重。这个过程将一直重复直到收敛。RBM使用隐藏单元对数据分布进行建模,而不使用标签信息。这在大数据分析中是一个非常有用的特性,因为DBN可以潜在地利用更多的数据(不知道它们的标签)来提高性能。

在预训练之后,输入数据的信息存储在每个相邻层之间的权重中。然后,DBN添加表示所需输出的最后一层,并且使用标记数据和反向传播策略对整个网络进行微调,以便更好地辨别(在一些实现中,在堆叠的rbm之上,有另一层称为由监督学习方法确定的关联存储器)。

对于预训练还有其他的变化:例如,除了使用RBMs之外,还提出了用于无监督特征学习的叠层去噪自动编码器[32]、[33]和叠层预测稀疏编码[34]。此外,最近的结果表明,当大量的训练数据可用时,使用随机初始权值而不是预先训练的权值(即,不使用RBMs或自动编码器)的完全监督训练将实际工作良好[13],[35]。例如,一个判别模型从一个单隐层网络(即浅层神经网络)开始,该网络通过反向传播方法进行训练。在收敛时,在这个浅层神经网络中插入一个新的隐层(在第一隐层和期望的输出层之间),然后再对整个网络进行判别训练。这个过程一直持续到达到预定的标准为止(例如,隐藏神经元的数量)。

总之,DBN使用贪婪和高效的逐层方法来学习每个隐藏层中的潜在变量(权重),并使用反向传播方法进行微调。这种混合训练策略提高了网络的生成性能和识别能力。

B.ensp;卷积神经网络

典型的CNN由许多层次结构组成,其中一些层次用于特征表示(或特征映射),另一些层次作为一种传统的神经网络用于分类[24]。它通常从两种不同类型的层(称为卷积层和子采样层)开始:卷积层使用多个大小相等的滤波器映射执行卷积操作,而子采样层通过在一个小邻域内平均像素(或通过最大池[36]、[37])来减小进行层的大小。

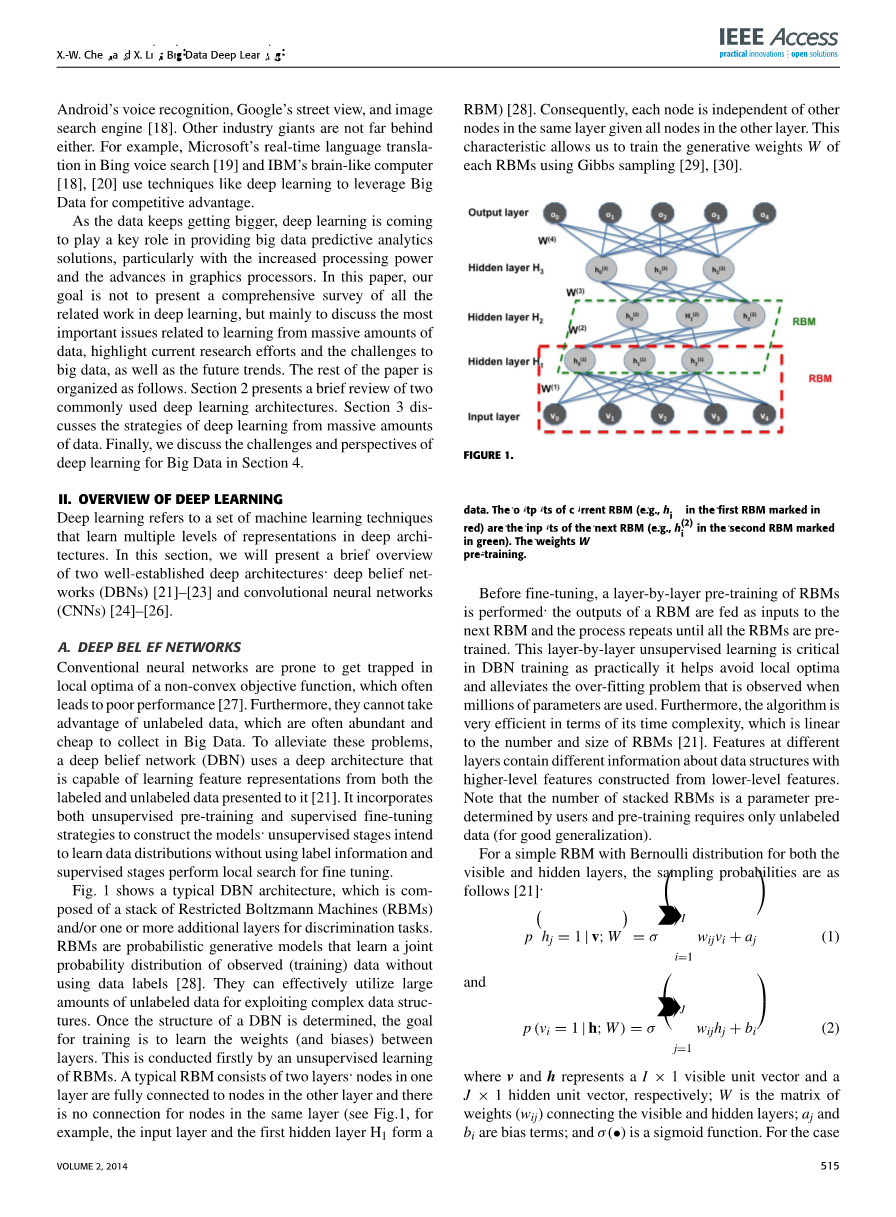

图2示出CNNs的典型架构。输入首先与一组滤波器(图2中的C层)卷积。这些二维过滤数据称为特征地图。在非线性变换之后,进一步执行子采样以降低维度(图2中的S层)。卷积/子采样序列可以重复多次(由用户预先确定)。

图 2. 典型卷积神经网络结构图示。输入是2D图像,该图像用四个不同的滤波器(即hi(1),i=1~4)卷积,然后进行非线性激活,以形成第二层(C1)中的四个特征映射。这些特征地图向下采样2倍,以在层S1中创建特征地图。卷积/非线性激活/子采样序列可以重复多次。在本例中,为了形成C2层中的特征映射,我们使用八个不同的滤波器(即hi(2),i=1到8):C2层中的第一、第三、第四和第六特征映射由S1层中的一个对应特征映射定义,每个特征映射用不同的滤波器卷积;C2层中的第二和第五特征映射由S1层中的两个映射形成用两个不同的滤波器卷积。最后一层是输出层,形成一个完全连通的1D神经网络,即,从最后一个子采样的2D输出(S2)将连接成一个长的输入向量,每个神经元与中的所有神经元完全连通。下一层(图中的隐藏层)。

如图2所示,该架构的最低层是以2dntimes;N图像作为输入的输入层。上层神经元利用局部感受野提取一些基本而复杂的视觉特征。每个卷积层(图2中标记为Cx)由多个特征映射组成,这些特征映射是通过使用不同的滤波器(权重向量)卷积输入来构造的。换言之,特征映射中每个单元的值是取决于前一层中的本地接收场和滤波器的结果。随后是非线性激活:

其中yj(l)是第l卷积层Cl的第j个输出;f(bull;)是非线性函数(最近的实现使用缩放双曲正切函数作为非线性激活函数[38]:f(x)=1.7159·tanh(2x/3))。Kij是滤波器组中的一个可训练滤波器(或内核),它与前一层的特征映射xi(l-1)卷积以在当前层中生成新的特征映射。符号N表示离散卷积算子,bj表示偏差。注意,每个滤波器Kij可以连接到前一层中的全部或部分特征映射(在图2中,我们展示了S1和C2之间部分连接的特征映射)。子采样层(图2中标记为Sx)降低了特征映射的空间分辨率(从而提供了某种程度的失真不变性)。通常,子采样层中的每个单元是通过平均特征映射中的2times;2区域或通过在一个小区域上的最大池来构造的。

确定的关键参数是层间权值,这些权值通常由标准的反向传播程序和以均方误差为损失函数的梯度下降算法来训练。或者,可以在无人监督的情况下培训深层CNN架构。本文综述了CNNs无监督训练的一种特

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[237767],资料为PDF文档或Word文档,PDF文档可免费转换为Word

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。