英语原文共 6 页,剩余内容已隐藏,支付完成后下载完整资料

在移动视频云中使用特征匹配进行有效的汽车视频检索

Kuan-Hui Lee, Jenq-Neng Hwang

Department of Electrical Engineering,

Box 352500, University of Washington,

Seattle, WA, 98195, USA

Jang-Hee Yoo

Human ID Research

Electronics and Telecommunications

Research Institute (ETRI),

Deajeon, S. Korea

Kyoung-Ho Choi

Department of Information amp; Electronics Engineering,

Mokpo National University,

Jeollanam-do, S. Korea

摘要——本文提出了一种新颖的应用程序,旨在从行车记录仪记录的汽车视频中搜索特定的场景/位置。假定汽车视频是通过移动云视频收集的,并且由无线宽带网络(例如WiMAX或LTE 4G网络)该搜索算法采用SIFT特征匹配和文本运动补偿匹配来检索最可能的视频片段。我们所做的工作是为SIFT和运动文本匹配提供单独的置信度,并根据重要的特征匹配的连续性有效的讲它们组合以识别匹配的视频片段。实验研究表明,该算法达到了96.65%的高精度检索率。

关键字——汽车视频检索;行车记录仪;尺度不变特征变换;文字检测;特征匹配;

- 介绍

如今,智能交通系统(ITS)视频分析的新兴应用是行车记录仪的使用,行车记录仪是一种在车辆记录视频以创建行车记录的设备。行车记录仪逐渐成为车辆中的必需品,可以将其视为道路上的移动摄像机。除了录制视频,车辆还可以通过全球定位系统(GPS)或其他电子设备获取其他驾驶信息,例如位置,时间和速度。行车记录仪提供了一种新的机制来扩展视频分析的应用程序。图1显示了一种可能的应用场景,其中ITS的服务器(即移动视频云)通过无线宽带网络(例如3G,WiMAX或LTE)连接到所有行驶中的车辆,从而可以轻松获得驾驶信息共享给ITS中的其他系统以供进一步使用。

应用服务器

自动事件检测

交通流量控制

ITS中的其他系统

无线网络

ITS中的其他网络

GPS,时间, GPS,时间, GPS,时间, GPS,时间, GPS,时间,

视频hellip;hellip; 视频hellip;hellip; 视频hellip;hellip; 视频hellip;hellip; 视频hellip;hellip;

车辆

车辆

车辆

车辆

车辆

车辆

车辆

图一 移动视频云框架

基于此移动网络云系统,假设在时间T在位置P发生了事件(车祸,抢劫等),警察希望对其进行重构以进行进一步调查。图2显示了这样一个示例,其中交叉路口的车辆3和5发生事故。

服务器

4

5

7

1

3

6

2

图二 基于移动网络的云系统的应用程序

传统方式是观看在事件现场周围部署的固定监控摄像机的视频。但是,由于摄像机部署不足,可能无法记录事件场景中发生的情况。幸运的是,由于事件发生时可能有许多车辆经过现场,因此其行车记录仪可能会提供事件的信息。检索出与该事件有关的汽车视频记录,,警察可以将事件发生的位置(基于在现场拍摄的参考查询图像)和事件发生时间提供给云服务器,然后该服务器可以广播到所有预安装的应用程序车辆以上传该事件需求匹配的视频。由于GPS的潜在误差和车辆的不同时钟设置,因此有必要在与事件相关的区域和持续时间的有限范围内获取视频。在此示例中,需要将围绕P的0.3平方英里(Pplusmn;0.3英里2)以及在T前后的2分钟(Tplusmn;2分钟)的视频上传到服务器。然而,即使在这样的时间和地点的限制条件下,警察仍然需要花费大量时间从许多记录的视频中过滤出所需的视频片段。在上面的示例中,在限制条件下选择了搜索范围内的视频,但是车辆2和6对事故调查没有帮助,因为行驶方向它们记录不到事故发生的过程。为了帮助警察有效地搜索与场景有关的视频片段,因此对于这些应用迫切需要一种有效的视频检索算法。

视频检索已成为多媒体研究领域的主要主题之一。在算法和框架的开发上许多工作都取得了令人瞩目的成就[1]。在[2]中,提出了一种视频检索系统,该系统支持基于对象的自动索引和时空查询。[3]中的工作利用5times;5块中的颜色直方图和颜色矩阵进行视频检索。在[4]中,该作品采用运动对象作为匹配特征来检索视频。这些作品在搜索场景稳定的视频(例如新闻视频,电影等)中表现出了高效的性能。但是,由于行车记录仪的视频帧非常不稳定,因此它们不适用于上述ITS应用。此外,所检索的场景在不同帧之间可以具有不同的比例。因此,因此考虑了尺度不变特征变换(SIFT)算法[5]。在[6]中,该作品使用SIFT来处理视频对象匹配。在[7]中,所作的工作通过SIFT功能跟踪和搜索视频中的对象。[8]中的作品提出了一种对象和场景检索的方法,可以通过SIFT将其重构为“可视”文本检索。这些作品有效地搜索了视频中不同比例的对象,但是它们的方案仍无法将匹配的特征与不同的观看方面进行匹配。为了克服这些问题,现场文本,例如商店名称,道路名称,餐厅名称等,可以在车载录像中轻松获得,也被认为是匹配的功能。因此,场景中商店和建筑物的名称或标志可以用作视频的关键索引。

许多著作[9]-[12]已经开发了用于视频中文本检测和识别的算法。这些视频光学字符识别(VOCR)的工作重点是标题/字幕的重叠文本识别,这些标题/字幕通常很清晰,并且文本位置固定在视频帧上。文献[13]中的工作提供了一种算法,可以从视频中检测出路标上的文字,但垂直平面假设不适用于自然场景中的文字。在[14]中,该方法通过使用特征颜色特征来检测路标上的文字。另一方面,[15]中基于垂直边缘和累积强度变形的算法在自然场景中表现良好。但是如何有效的的将SIFT和文本功能的匹配结合起来以进一步提高检索性能是一个巨大的挑战。

为了克服上述挑战,本文提出了一种基于录制的驾驶视频的新颖视频检索算法。考虑到时间特征匹配的连续性,SIFT特征和文本匹配均具有单独的置信度,以量化场景和视频之间的关联。该算法的作用是有效地组合两个置信度,以便提取与场景关联的可能的视频片段。

本文的其余部分安排如下。在第二部分中,对提出的算法进行了概述。第三节详细介绍了SIFT功能匹配。第四节介绍了文本匹配的详细信息。第五节介绍了特征匹配及其组合的置信度。实验结果在第六节中显示,随后在第七节中得出结论。

- 提出算法的概述

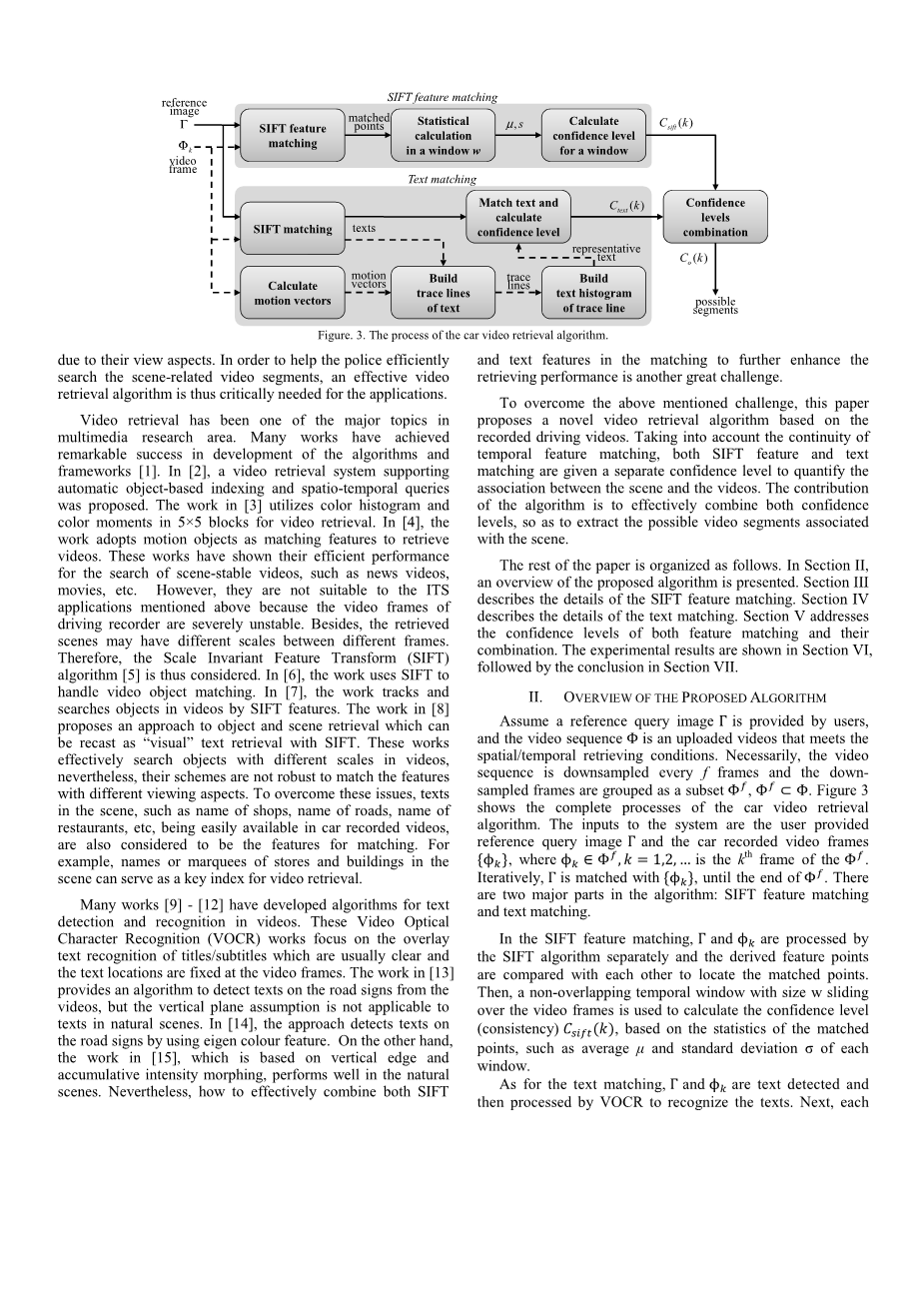

假设参考查询图像Gamma;由用户提供,视频序列Phi;是满足空间/时间检索条件的上传视频。然后对视频序列每f帧进行降采样,并且降采样后的帧被分组为子集Phi;f,Phi;fcPhi;。图3显示了汽车视频检索算法的完整过程。系统的输入是用户提供的参考查询图像Gamma;和汽车记录的视频帧{Phi;k},其中Phi;kEPhi;f,k =1,2,hellip;是Phi;f的k日帧。迭代地将Gamma;与{Phi;k}匹配,直到Phi;f的结尾。该算法有两个主要部分:SIFT特征匹配和文本匹配。

图三 汽车视频检索算法过程

在SIFT特征匹配中,分别通过SIFT算法处理Gamma;和Phi;k,并将导出的特征点相互比较以找到匹配点。然后,基于匹配点的统计信息(例如平均mu;和标准偏差),使用大小w在视频帧上滑动的非重叠时间窗口来计算置信度(一致性)Csift(k)每个窗口的sigma;。

对于文本匹配,检测Gamma;和Phi;k文本,然后由VOCR处理以识别文本。接下来,沿着估计的运动矢量的每个检测到的文本Phi;k与随后帧中的文本Phi;k 1,相连接,以便链接文本的跟踪线。然后,每条迹线将构建一个文本直方图,以便可以由多数投票确定最具代表性的文本。最后,将Gamma;中的文本与Phi;k中的文本进行比较,并获得置信度来表示文本匹配的程度。

一旦确定了Csift(k)和Ctext(k),该窗口的置信度Co(k)通过分配对这两个置信度分别使用不同的权重Wsift和Wtext。如果一种类型的特征始终比另一种类型的可信度更重要,那麽给它提供更高的权重是合理的。然后,可以将匹配的窗口Yk,

通过阈值Co(k)确定。最后将所有匹配的窗口Yk进行分组并返回给用户

图四 图示SIFIT的特征匹配的置信度

- SIFT特征匹配

SIFT [5]算法已成功用于检测和描述图像的局部特征。SIFT功能不仅对图像缩放,平移和旋转不变,而且对照明变化,仿射失真,噪声增加甚至部分遮挡也部分不变。由于其在特征匹配方面的卓越性能,SIFT已被广泛用于视频检索[6] [7]。

为了将有意义程度的SIFT特征匹配分配给不重叠的视频窗口,本文计算了w个连续帧的窗口的置信度。我们将Ptm(i)定义为参考查询图像的SIFT特征匹配点数与总SIFT特征数之比,其中k-wfrasl;2lt;=ilt;=k wfrasl;2。如果窗口内足够大的Ptm(i)的数量(即Ptm(i)gt; rl,rl是阈值)大于经验预定义的阈值delta;l,则将该帧窗口视为候选视频窗口。通过基于Ptm(i)的平均值与所选值之间的距离得出统计置信度C筛(k)进一步验证此候选窗口阈值rl。图4显示了定义,其中micro;k是此窗口内{Ptm(i)}的平均值。假设一个为Ptm(k)定义的随机变量Z,pdf为f(z),而ak是Ptm(k)小于rl的概率,即参考查询图像与视频帧不匹配的概率。根据定义,可以将ak计算为(鉴于选定的rl)

根据中心极限定理,z可以归一化为

如果窗口尺寸w lt;30或z分布[16], 则f(z)是t分布的,其中是窗口的标准偏差。为了提高效率,可以通过查表获得(1)的cdf。对于窗口,匹配的概率,即置信度Csift(k)等于(1-ak)。

图五 文本检测示例

图六 文本匹配的文本跟踪线的示意图

- 文字匹配

文本匹配用于检测,识别和匹配Gamma;和Phi;k中的文本,还可以得出匹配的置信度。该算法在[15]中采用了文本检测方案,在[17]中采用了OCR。图5显示了一个文本检测示例,其中商店字幕标志和路牌上的文本被很好地检测和识别。但是,由于不同的观看角度,相机的振动或VOCR的错误,相邻帧中的相同文本可能会被识别为不同的文本。为了解决该问题,考虑相邻帧之间的文本的时空关系来链接相似的文本。

假设Gamma;和Phi;k中的文本别识别并被定义为分离的和,其中,其中分别为Gamma;和Phi;k中已识别的文本数量。对于每一个,从Phi;k到Phi;k 1的运动矢量首先通过基于块的运动估计并且映射到。然后沿着运动矢量逐帧在框架中建立文本跟踪链接定义L[r]的对应关系。其中r是已识别文本的索引。在每个L [r]中,具有代表性的文本均以多数票选出。图6显示了文本跟踪线的图示。例如,L [1]是与文本对应的跟踪线从到的“三明治”。在L [4]中,对应的文本“ lucky”是从第到第。最后,将每个tr[p]与{L [r]}的代表文本进行比较。如果tr[p]与L [r]的代表文本匹配,则假定该文本与该t匹配。

最后,将置信度Csift(k)定义为Gamma;中匹配的文本数与文本总数之比

- 置信水平组合

为了有效地组合来自SIFT和文本匹配的两个置信度,考虑了自适应加权组合函数,以便总置信度可以将更多置信度放在具有更一致的重要特征匹配的置信度上。也就是说,总置信度Co(k)定义为

其中wl(k)和w2(k)是分别用于SIFT特征匹配和文本匹配的权重,并且wl w2=1。

假设包括在窗口Upsilon;k周围的s个相邻候选窗口的相邻视频集R,即R = {Upsilon;k-s/2,hellip;,Upsilon;k-l,Upsilon;k,Upsilon;k l,Upsilon;k s/2}。对于SIFT特征匹配,重要的特征匹配窗口意味着该窗口的Csift(k)大于阈值。如果此视频集中有更多的窗口有意义,则认为功能匹配更加一致。为了描述一致性水平,与Yk有关的比率定义为

其中Ssift(k)是与Upsilon;k相对应的相邻视频集R中重要特征匹配窗口的数量。

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[235591],资料为PDF文档或Word文档,PDF文档可免费转换为Word